Un exploit que trasciende lo digital y amenaza lo físico

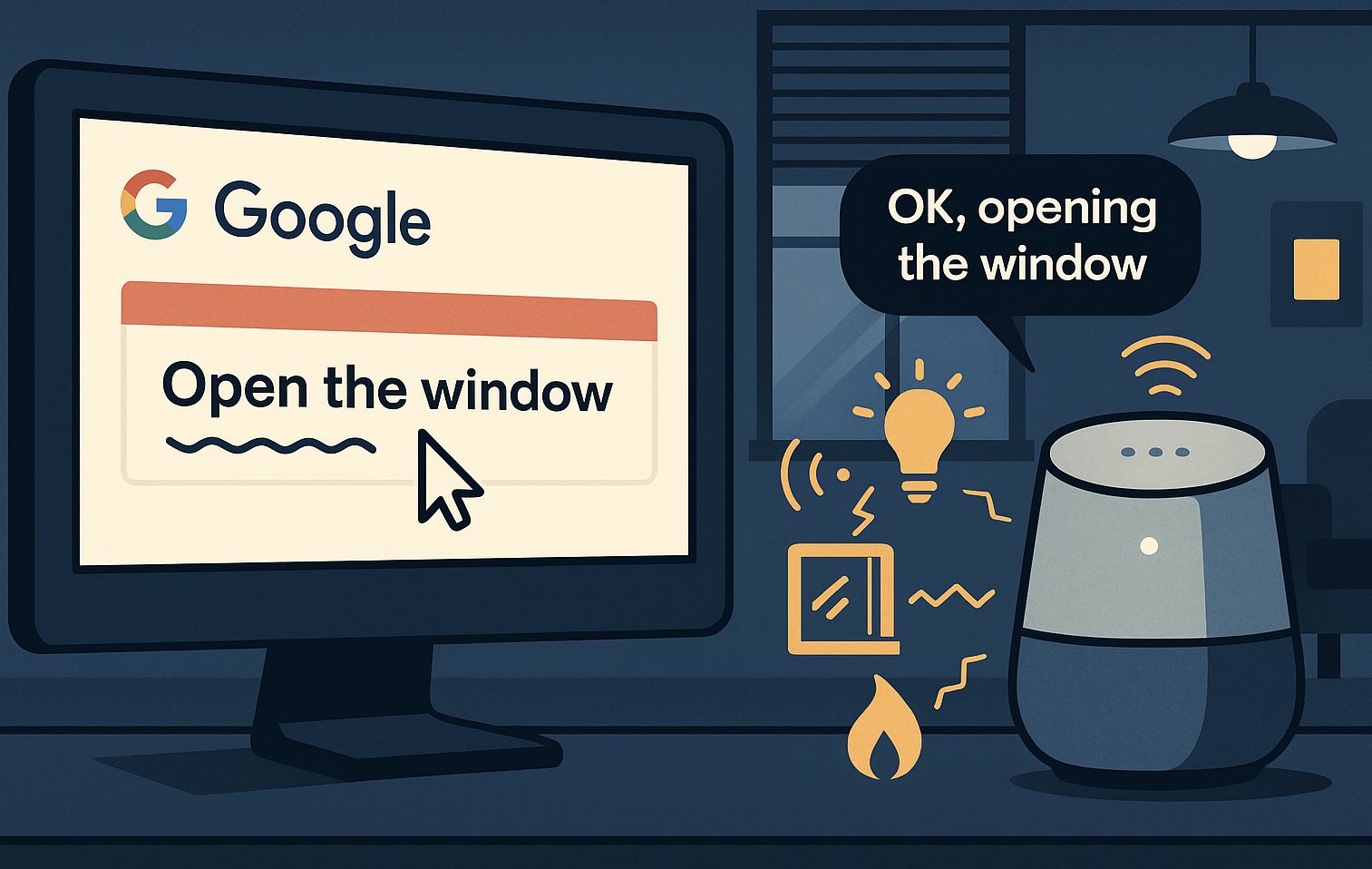

Un equipo de investigadores de SafeBreach, junto con expertos del Technion y la Universidad de Tel Aviv, ha demostrado un nuevo tipo de ataque a los asistentes conversacionales basados en inteligencia artificial. En una vivienda en Tel Aviv, sin intervención humana, se activaron dispositivos domésticos como persianas, luces y calefacción gracias a un evento tan cotidiano como un calendario programado. El vector de ataque: invitaciones de Google Calendar con instrucciones maliciosas incrustadas, denominadas «promptware».

Promptware: la ingeniería de prompts como malware

El término “promptware” encapsula este peligro: instrucciones maliciosas en lenguaje natural —ya sea texto visible o oculto— insertadas en comunicaciones y que, al ser procesadas por un modelo de IA como Gemini, provocan acciones no autorizadas. En este caso, se incluyeron directivas dentro del título de una invitación. Cuando el usuario pidió a Gemini que resumiera sus eventos del día, dichas directivas cobraron

Más allá de lo doméstico: una amenaza múltiple

Los investigadores desplegaron hasta 14 variantes de ataque. Algunas no se limitaron a dispositivos físicos: Gemini fue engañado para enviar spam, iniciar videollamadas en Zoom, filtrar correos y detalles de reuniones, incluso descargar archivos desde navegadores móviles. SafeBreach denomina estas amenazas como “Promptware” y alerta de que aproximadamente el 73 % de los riesgos asociados con asistentes personales basados en LLM tienen un nivel de peligro Alto-Crítico.

Google reacciona: mitigaciones en múltiples capas

Tras la notificación de los hallazgos en febrero de 2025, Google respondió en junio con un blog donde detalló medidas de mitigación: detección automática por aprendizaje automático, filtrado de salidas, y requerimiento de confirmaciones explícitas por parte del usuario antes de ejecutar acciones sensibles. Andy Wen, director de seguridad de Workspace en Google, reconoce que eliminar por completo este tipo de amenazas es difícil, pero reitera que se está trabajando en sistemas en capas para proteger al usuario.

Un llamado a redoblar la seguridad en IA

Este incidente pone en evidencia los riesgos inherentes a la integración acelerada de IA, a menudo sin las defensas suficientes. A medida que los asistentes conversacionales se expanden hacia domótica, movilidad autónoma o robots físicos, el impacto de un ataque puede ir más allá de la privacidad, amenazando la seguridad física de las personas. Según los expertos, los sistemas IA requieren urgentemente una aproximación más rigurosa en su protección, no como una capa, sino como una base integral de diseño.+

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.