Anthropic, la compañía detrás del asistente conversacional Claude, ha implementado una nueva política de datos que obligará a todos sus usuarios a decidir antes del 28 de septiembre de 2025 si desean que sus conversaciones sean utilizadas para entrenar sus modelos de inteligencia artificial. En caso de no hacerlo, perderán acceso al servicio. Esta medida marca un giro sustancial frente a la práctica anterior, donde los chats de los usuarios se eliminaban tras 30 días, salvo aquellos revisados por razones de seguridad.

A partir de ahora, Anthropic mantendrá las conversaciones —incluyendo sesiones de chat y código— hasta cinco años en caso de que los usuarios no opten por excluirse del entrenamiento de modelos. La actualización se aplica a las versiones de consumidor: Claude Free, Pro, Max y Claude Code, mientras que cuentas corporativas como Claude Gov, Claude for Work o integraciones vía API (por ejemplo, Amazon Bedrock o Google Cloud Vertex AI) se encuentran exentas.

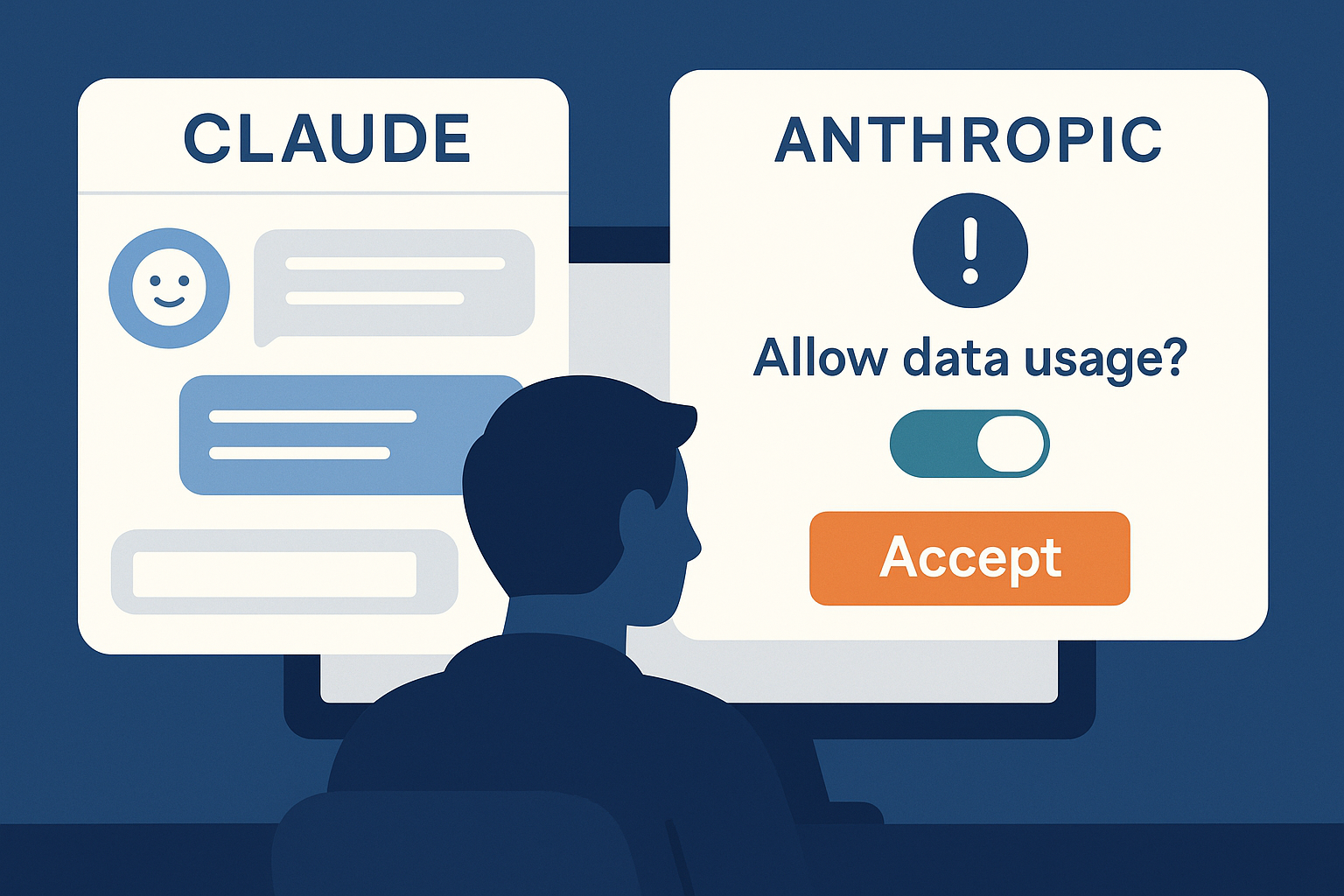

Los usuarios recibirán un aviso emergente —etiquetado como “Updates to Consumer Terms and Policies”— donde encontrarán un botón grande de «Accept» y un interruptor más pequeño, activado por defecto, que habilita el uso de sus datos para entrenamiento. Esta interfaz ha sido criticada por expertos en privacidad por su diseño poco transparente, que podría inducir a que los usuarios acepten sin darse cuenta.

Anthropic defiende que este enfoque aporta beneficios claros: refinar los sistemas de detección de contenido dañino, mejorar capacidades de razonamiento y codificación, y en consecuencia, ofrecer modelos más seguros y potentes para todos los usuarios que participen. Subrayan también que solo se utilizarán los datos de nuevas conversaciones o las reactivadas; las sesiones antiguas o inactivas no serán usadas salvo que se reanuden.

No obstante, esta modificación ha generado inquietud en defensores de la privacidad, quienes denuncian que Anthropic ha pasado de un modelo de opt-in a uno de opt-out para el entrenamiento de modelos, lo que representa una regresión significativa en términos de consentimiento informado. Además, se señala que, a pesar de que Anthropic asegura que no vende los datos y que emplea procesos automáticos para filtrar información sensible, una vez los datos se utilizan, no se pueden recuperar ni eliminar retrospectivamente.

Este movimiento ocurre en un contexto competitivo donde Anthropic busca mantenerse a la vanguardia frente a rivales como OpenAI y Google. Mantener conversaciones de usuario como fuente de entrenamiento ofrece una ventaja estratégica para refinamiento de sus modelos, lo que subraya la presión que enfrentan estas empresas en el entorno de la IA generativa. Paralelamente, este enfoque suscita dudas sobre la extensión real del consentimiento del usuario y la transparencia con que se está ejerciendo.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.