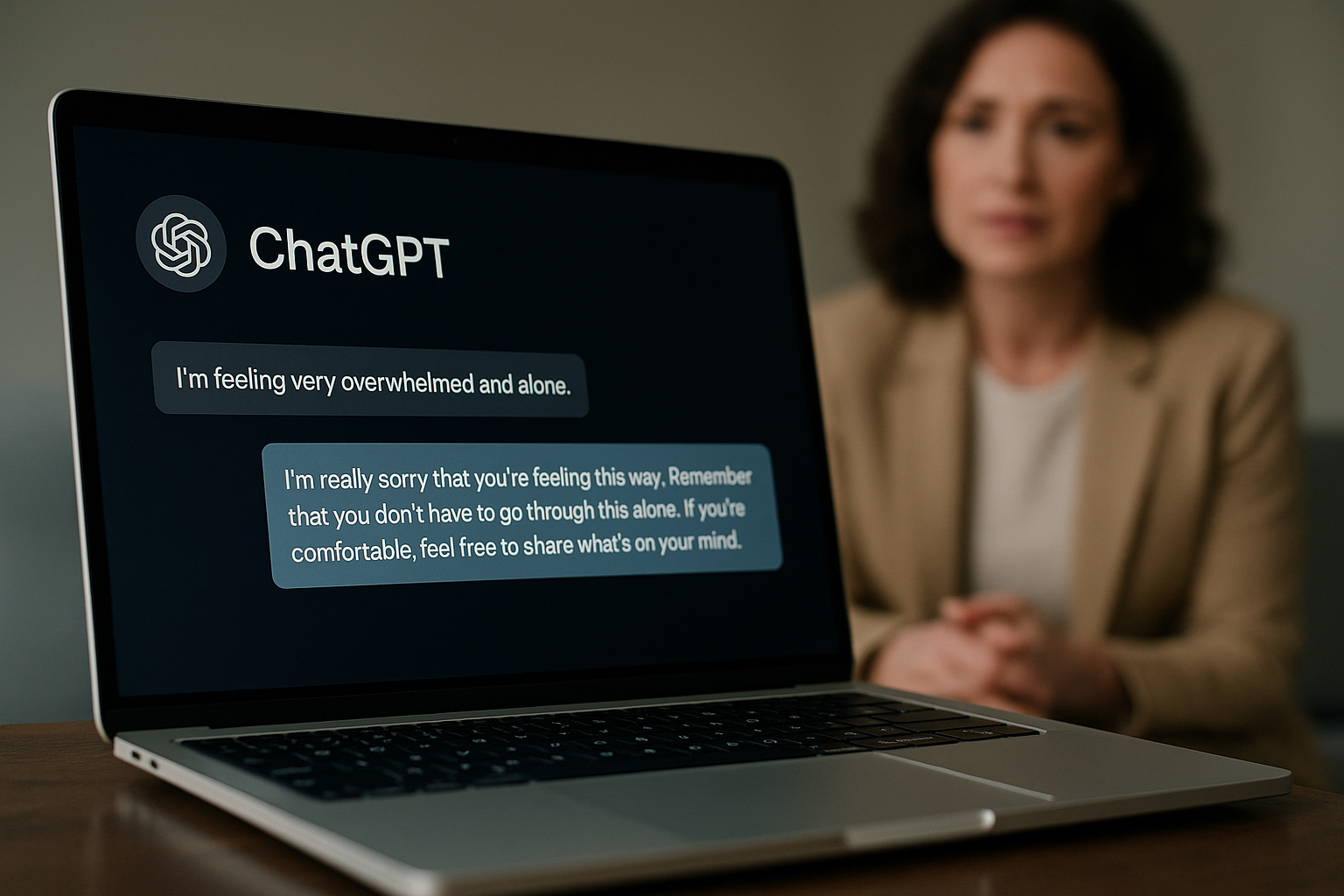

OpenAI ha rediseñado cómo responde ChatGPT en conversaciones sensibles, como las que tocan salud mental, violencia o pérdida. Lo ha hecho con un nuevo enfoque que combina supervisión humana, aprendizajes automáticos y protocolos de seguridad. La apuesta es que el modelo no solo entienda lo que se le dice, sino que sepa cómo responder con cuidado, sin perder utilidad.

Un modelo que escucha distinto

Desde principios de año, OpenAI ha estado entrenando versiones de ChatGPT con modelos que reconocen mejor el tono, la intención y el contenido emocional de las preguntas. El cambio no se limita a afinar palabras, busca que las respuestas sean más empáticas y seguras, especialmente cuando alguien menciona, por ejemplo, que se siente solo o en peligro. El rediseño comenzó con pruebas en conversaciones sobre salud mental. Se analizaron patrones de uso reales (de forma anónima y bajo control ético) para detectar cuándo una respuesta podía resultar fría, evasiva o incluso contraproducente. A partir de ahí, se entrenaron nuevos comportamientos con ayuda de profesionales y supervisores humanos.

OpenAI colaboró con más de 170 expertos en salud mental en este rediseño. Según su evaluación, el nuevo modelo alcanzó una tasa de cumplimiento del 92 % frente al 27 % del modelo anterior (de agosto de 2025) al responder en más de mil conversaciones desafiantes.

Qué busca y qué evita ahora ChatGPT

El objetivo no es que ChatGPT actúe como terapeuta ni sustituya el apoyo profesional. Lo que sí pretende es identificar señales de malestar, evitar respuestas que puedan agravar la situación y ofrecer recursos útiles, como líneas de ayuda. El nuevo modelo también evita desviar la conversación de forma automática o dar respuestas neutras cuando no es lo adecuado. Por ejemplo, antes podía responder con un simple “Lamento oír eso” ante menciones de duelo o ansiedad. Ahora, intenta contextualizar mejor, mostrar comprensión y ofrecer opciones concretas, sin caer en dramatismos ni paternalismos.

Según datos de OpenAI, las respuestas que no cumplían con los estándares deseados se redujeron entre un 65 y 80 % tras la actualización. Además, se estima que solo el 0,07 % de los usuarios activos en una semana mencionan posibles signos de emergencia relacionados con psicosis o manía, generalmente en un único mensaje.

Datos sensibles, decisiones cuidadosas

OpenAI asegura que no utiliza las conversaciones individuales para entrenar a sus modelos sin permiso del usuario. Aun así, las mejoras se han basado en ejemplos supervisados y evaluaciones éticas, con especial cuidado en los temas donde hay mayor riesgo. No se trata solo de evitar errores, sino de entender que algunas respuestas pueden tener consecuencias reales.

La compañía también ha reforzado los sistemas de seguridad que detectan situaciones de emergencia. Si alguien menciona ideas suicidas, por ejemplo, el modelo puede activar respuestas específicas y guiar hacia ayuda especializada. Además, se han añadido recordatorios para que el usuario tome descansos tras sesiones prolongadas.

El dilema de cuidar sin vigilar

Uno de los retos es mantener el equilibrio entre ayuda y privacidad. ChatGPT no debe convertirse en un sistema de monitoreo emocional ni intervenir de forma intrusiva. Por eso, las respuestas están diseñadas para ser útiles sin dar por hecho el estado emocional del usuario, y sin almacenar información sensible. El sistema tampoco actúa como si supiera más de lo que sabe, evita dar diagnósticos o consejos médicos, y redirige hacia profesionales cuando es necesario. En palabras de OpenAI, se trata de “responder con cuidado, no de asumir el rol de experto”.

Un espejo en constante ajuste

Las mejoras ya están activas en la versión gratuita y Plus de ChatGPT, y seguirán afinándose con más pruebas. Lo que está en juego no es solo la precisión de una IA, sino su capacidad de responder con humanidad simulada cuando más se necesita. OpenAI reconoce que se trata de situaciones de muy baja prevalencia, donde incluso pequeños cambios en los criterios de evaluación pueden alterar significativamente los resultados. Por eso, el sistema sigue bajo revisión y ajustes constantes, con participación de expertos y nuevas métricas de seguimiento.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.