La nueva función de Claude no se limita a responder preguntas: ejecuta tareas reales en tu ordenador, abre aplicaciones, navega, rellena hojas de cálculo y convierte la inteligencia artificial en un agente operativo que actúa en tu lugar.

La inteligencia artificial está entrando en una nueva fase. Durante años, los asistentes digitales han sido herramientas de apoyo: responden, sugieren, redactan o resumen. Pero Anthropic acaba de cruzar una frontera mucho más ambiciosa con Claude. Su nueva funcionalidad permite que la IA tome el control del ordenador del usuario y ejecute tareas de forma autónoma, utilizando el teclado, el ratón y la pantalla como si fuera una persona sentada frente al equipo. El cambio no es incremental. Es estructural.

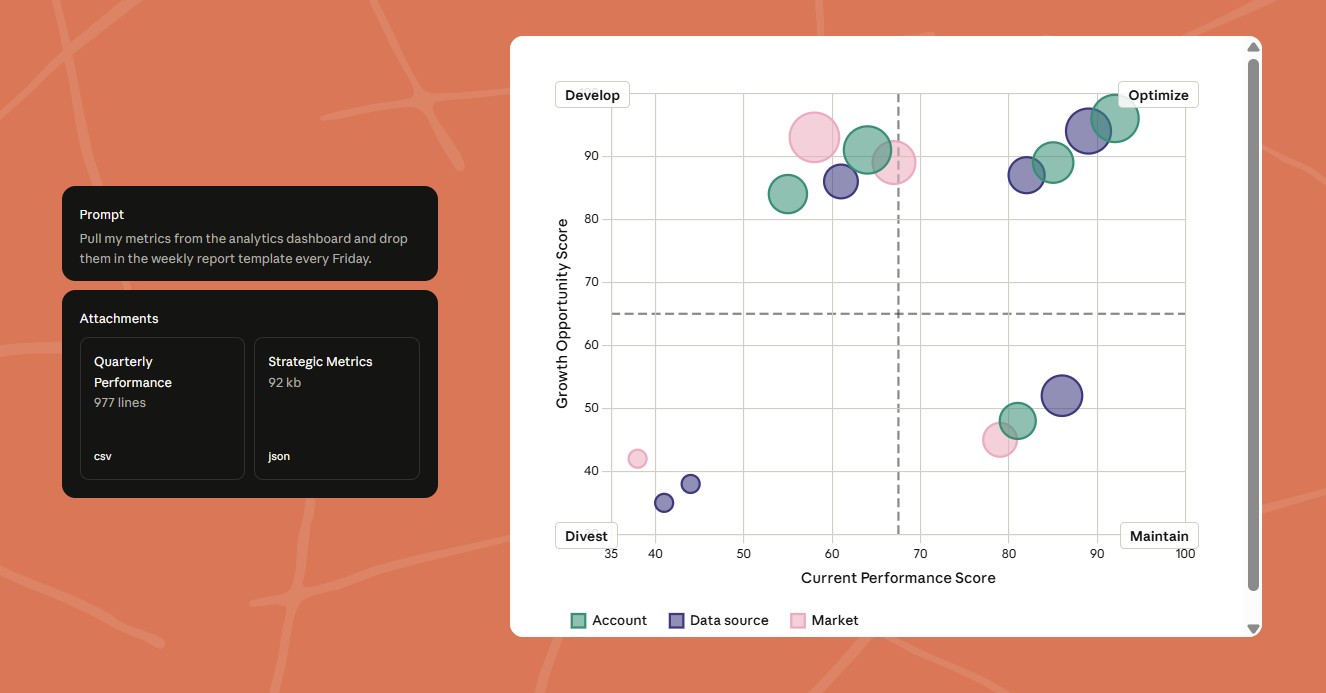

Según la propia compañía, esta capacidad ya puede activarse en una vista previa dentro de Claude Cowork y Claude Code, donde el sistema actúa como un agente capaz de operar aplicaciones reales. El planteamiento es directo: Claude deja de ser un interlocutor y se convierte en un ejecutor. Abre programas, navega por el navegador, rellena hojas de cálculo, consulta correos o gestiona flujos de trabajo completos sin intervención constante del usuario. ()

El concepto introduce una mutación clave en la relación entre humanos e inteligencia artificial. Hasta ahora, el usuario debía traducir una intención en instrucciones detalladas, supervisar el proceso y ejecutar manualmente muchas acciones. Con esta nueva función, el modelo se sitúa en otro nivel: entiende el objetivo y se encarga de recorrer los pasos necesarios dentro del sistema operativo. Es decir, pasa de asistir a delegar trabajo completo.

Felix Rieseberg, responsable de ingeniería de Claude Cowork y Claude Code Desktop, lo explicaba con claridad al presentar la herramienta: Claude puede controlar el ordenador mediante ratón, teclado y pantalla, lo que le permite operar cualquier aplicación. Esta afirmación es relevante porque elimina una de las grandes limitaciones de los asistentes actuales: la dependencia de integraciones específicas. Si una herramienta no tiene API o conector, el sistema puede interactuar directamente con la interfaz visual.

Ese detalle cambia las reglas del juego. En lugar de construir ecosistemas cerrados basados en integraciones, Anthropic introduce un modelo más universal: si tú puedes hacerlo en pantalla, Claude también puede hacerlo. Esto incluye desde tareas simples —abrir documentos, copiar datos, enviar correos— hasta procesos más complejos como construir informes, gestionar dashboards o coordinar aplicaciones múltiples en paralelo.

Uno de los aspectos más significativos es su capacidad para trabajar de forma asincrónica. El usuario puede asignar una tarea desde el móvil y desentenderse. Claude la ejecuta en el ordenador y, cuando el usuario vuelve, el trabajo está hecho. Este modelo rompe con la interacción tradicional en tiempo real y acerca la IA a un sistema de delegación laboral automatizada.

El ejemplo que ofrece la propia plataforma es revelador: pedirle a Claude que revise el correo cada mañana o que genere un informe cada viernes. A partir de ese momento, la IA se encarga de ejecutar la tarea de forma recurrente. No es solo automatización puntual; es una forma de externalizar rutinas enteras.

El sistema, además, prioriza el uso de aplicaciones conectadas como Slack, el calendario u otras herramientas integradas. Pero cuando no existe un conector disponible, solicita permiso explícito para interactuar directamente con el software abierto en pantalla. Esta capa de autorización intenta resolver una de las principales preocupaciones: el control del usuario.

Porque aquí aparece el otro gran eje del debate: el riesgo. Dar acceso a una inteligencia artificial para que opere un ordenador implica abrir una superficie de acción mucho más amplia que la de un chatbot convencional. Ya no se trata de generar texto incorrecto o de ofrecer respuestas imprecisas. Se trata de ejecutar acciones reales: enviar correos, modificar documentos, acceder a datos sensibles o interactuar con sistemas críticos.

Anthropic es consciente de esa tensión y por eso presenta la función como una research preview limitada. Actualmente solo está disponible en macOS y para usuarios de planes Pro y Max. El despliegue gradual indica que la compañía está probando no solo la tecnología, sino también el modelo de confianza necesario para que los usuarios acepten este tipo de delegación.

Este movimiento no puede entenderse sin el contexto competitivo actual. OpenAI ya ha avanzado en esa dirección con capacidades de agentes en ChatGPT, mientras que Google está integrando funciones similares en Gemini. La carrera ya no gira únicamente en torno a quién responde mejor, sino a quién actúa mejor. La IA conversacional está evolucionando hacia IA operativa.

En ese escenario, Anthropic busca posicionarse con una propuesta clara: sistemas más seguros, más controlados y con un enfoque empresarial fuerte. Pero el lanzamiento de esta función coincide también con un momento de presión política creciente en Estados Unidos sobre las grandes empresas de inteligencia artificial.

En los últimos meses, el entorno regulatorio se ha endurecido, especialmente tras el retorno de una agenda más agresiva hacia las tecnológicas impulsada por el entorno político de Donald Trump. La Casa Blanca ha intensificado el escrutinio sobre compañías de IA, incluyendo debates sobre seguridad nacional, uso de datos, control de modelos avanzados y concentración de poder tecnológico.

Anthropic ha sido una de las empresas en el centro de esa tensión. Su modelo de desarrollo, más prudente en términos de seguridad que el de algunos competidores, no la ha librado del debate político. De hecho, la presión regulatoria ha empujado a las compañías a demostrar no solo capacidad técnica, sino también utilidad económica y legitimidad social.

En ese contexto, el lanzamiento de una función como el control del ordenador tiene una doble lectura. Por un lado, es un avance tecnológico evidente. Por otro, es una respuesta estratégica: demostrar que la IA no es solo un riesgo potencial, sino una herramienta productiva capaz de generar valor directo.

Anthropic está diciendo, en la práctica, que su tecnología puede integrarse en el trabajo diario y mejorar la productividad de forma tangible. No es casual que el foco esté en tareas de oficina, automatización y gestión. La empresa busca posicionar a Claude como una pieza central en el futuro del trabajo digital.

Sin embargo, esta narrativa abre nuevas preguntas. Si una IA puede hacer tu trabajo en el ordenador, ¿qué parte de ese trabajo sigue siendo humana? ¿Dónde se sitúa el valor diferencial? ¿En la ejecución, en la supervisión o en la definición de objetivos?

La historia reciente de la automatización sugiere que cada salto tecnológico desplaza el valor hacia niveles más abstractos. Primero desaparecen las tareas mecánicas, luego las repetitivas y, progresivamente, parte del trabajo cognitivo estructurado. Lo que introduce Claude con esta función es la automatización de la interacción directa con el entorno digital, que hasta ahora había sido uno de los últimos reductos humanos.

Esto tiene implicaciones profundas para empresas y profesionales. Por un lado, permite una eficiencia sin precedentes: menos tiempo en tareas operativas, más capacidad de escala. Por otro, obliga a redefinir roles, procesos y responsabilidades.

También redefine la interfaz misma de la computación. Durante décadas, el ordenador ha sido una herramienta que requiere interacción directa: teclado, ratón, pantalla. Ahora, esa interfaz se convierte en una capa intermedia que la IA puede manejar por nosotros. El usuario deja de interactuar con el sistema operativo y pasa a interactuar con un agente que lo hace en su nombre.

Este cambio puede parecer sutil, pero no lo es. Supone pasar de un modelo de uso a un modelo de delegación. Y ese es probablemente el mayor salto conceptual de esta tecnología.

A corto plazo, veremos cómo estas funciones se consolidan en entornos profesionales: asistentes que preparan informes, gestionan correos, organizan agendas o automatizan tareas administrativas. A medio plazo, el modelo podría extenderse a sistemas más complejos, integrando múltiples aplicaciones y procesos empresariales.

Pero el verdadero desafío no será técnico, sino cultural y regulatorio. La adopción de agentes con capacidad de acción real dependerá de la confianza, de los mecanismos de control y de la claridad sobre responsabilidades en caso de error.

Anthropic ha dado un paso que muchos anticipaban, pero que pocos habían materializado con esta claridad: convertir la IA en un operador digital completo. La pregunta ya no es si la inteligencia artificial puede ayudarte a trabajar. Es si puede trabajar por ti.

Y, en ese nuevo escenario, la frontera entre herramienta y sustituto empieza a difuminarse.