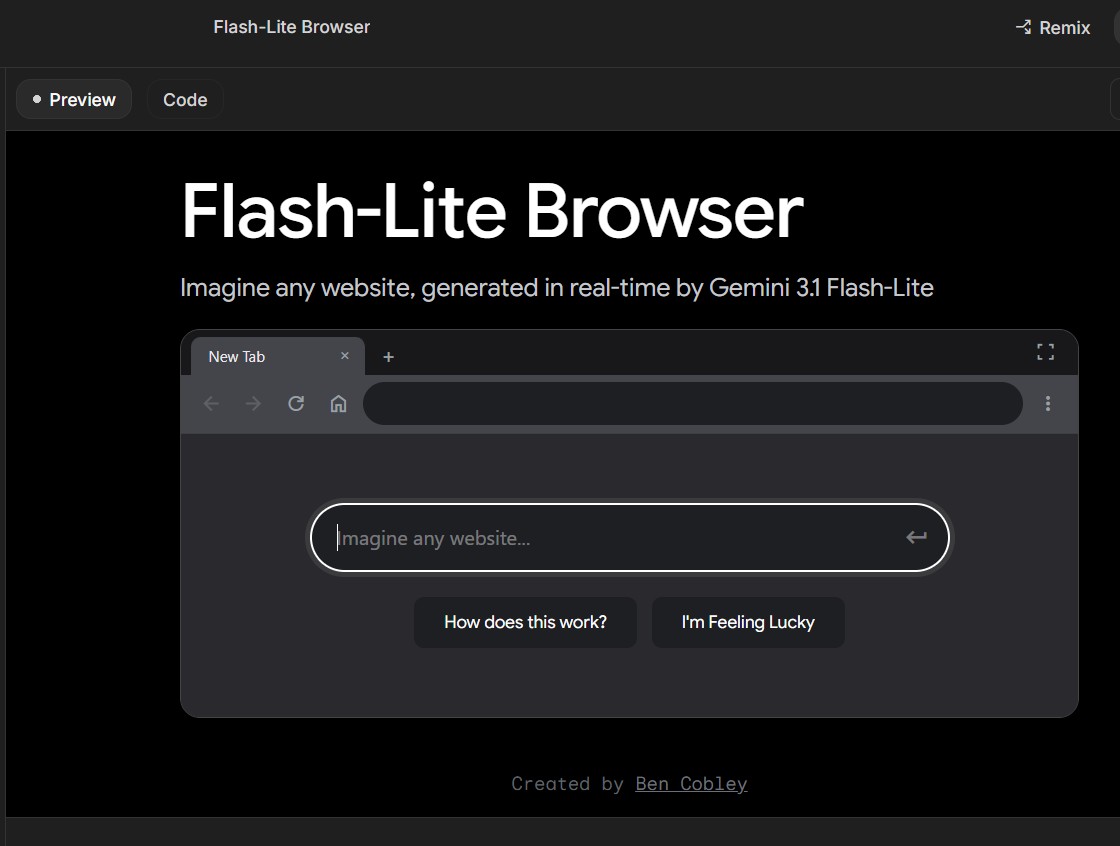

La demo de Google DeepMind no enseña solo un modelo rápido: enseña un navegador experimental en el que cada página se genera en tiempo real mientras el usuario hace clic, busca y navega, una señal clara de que la web puede empezar a comportarse menos como un conjunto de sitios estáticos y más como una interfaz generada al vuelo por IA.

Google DeepMind ha decidido mostrar Gemini 3.1 Flash-Lite con una imagen especialmente elocuente de hacia dónde quiere empujar la siguiente fase de la inteligencia artificial aplicada al software: un navegador capaz de crear cada página en tiempo real a medida que el usuario interactúa con ella. La pieza de demostración difundida por la compañía presenta precisamente eso: un entorno en el que la experiencia de navegación deja de depender por completo de páginas previamente construidas y pasa a estar mediada por generación instantánea. No es un detalle menor ni un simple truco visual. Es una manera de enseñar que, cuando la latencia cae lo suficiente, la IA deja de sentirse como una capa adicional y empieza a confundirse con la propia interfaz.

El punto de partida técnico de esa demostración es Gemini 3.1 Flash-Lite, el modelo que Google presentó a comienzos de marzo de 2026 como el más rápido y más eficiente en costes dentro de la familia Gemini 3. Según la propia compañía, está pensado para cargas de trabajo de alto volumen, con baja latencia y necesidades de respuesta inmediata, y se está desplegando en vista previa para desarrolladores en Google AI Studio y para clientes empresariales en Vertex AI. Google lo posiciona explícitamente como un modelo orientado a experiencias responsivas en tiempo real.

Ese posicionamiento explica por qué la demo del navegador tiene tanta carga estratégica. Durante la última etapa de la IA generativa, buena parte de la conversación se ha centrado en calidad de razonamiento, longitud de contexto o potencia de los modelos de gama alta. Pero Google está subrayando aquí otra variable igual de decisiva: la velocidad percibida. Si un modelo puede generar una página mientras el usuario navega sin romper la sensación de continuidad, entonces se abre una categoría nueva de producto. Ya no se trata solo de pedirle a una IA que redacte una web o construya un prototipo, sino de usarla como motor de renderizado dinámico para experiencias interactivas.

La compañía no oculta que 3.1 Flash-Lite ha sido concebido exactamente para ese tipo de escenarios. En su anuncio oficial, Google afirma que el modelo ofrece una mejora de 2,5 veces en el tiempo hasta el primer token de respuesta frente a Gemini 2.5 Flash y un aumento del 45% en la velocidad de salida, manteniendo una calidad similar o superior en su categoría. Añade además que esa baja latencia es la que hace posible flujos de trabajo de alta frecuencia y experiencias en tiempo real. La demo del navegador no es, por tanto, una ocurrencia aislada: es una exhibición coherente con la tesis comercial del modelo.

Google DeepMind presenta además Flash-Lite como un modelo “scalable thinking” para tareas de alto volumen y bajo coste. En la ficha oficial del modelo, la compañía destaca que sirve para codificación, generación de interfaces de usuario y traducción, y remarca cuatro rasgos: niveles de razonamiento flexibles, baja latencia, uso de herramientas y eficiencia económica. Todo ello perfila una idea muy clara: Flash-Lite no está pensado para ganar la batalla del prestigio frente a los modelos más pesados, sino para colonizar el terreno donde la IA necesita estar presente de forma constante, rápida y barata.

Ahí es donde la demostración del navegador gana profundidad. Lo que parece a primera vista una curiosidad técnica en realidad funciona como una hipótesis sobre la futura arquitectura de la web. Durante décadas, navegar ha significado visitar páginas ya diseñadas, servidas por un backend y renderizadas por el navegador. El experimento mostrado por Google sugiere otra posibilidad: que parte de esa capa de presentación pueda generarse bajo demanda, personalizada y adaptada al contexto de navegación del usuario. Si cada clic, cada búsqueda y cada desplazamiento pueden activar generación instantánea de interfaz, la propia noción de página web se vuelve más líquida.

Ese desplazamiento encaja con una línea más amplia que Google lleva meses explorando. En la documentación pública del modelo, la empresa muestra ejemplos de Flash-Lite poblando en segundos un wireframe de comercio electrónico con cientos de productos en múltiples categorías y construyendo paneles meteorológicos dinámicos con datos en tiempo real e históricos. Son casos que no solo hablan de escribir texto o responder preguntas, sino de construir representación visual, estructura de interfaz y contenido útil casi al instante. El navegador experimental es, en cierto modo, la extrapolación más visible de esa capacidad.

La promesa técnica también se apoya en el precio. Google sitúa a Gemini 3.1 Flash-Lite en 0,25 dólares por millón de tokens de entrada y 1,50 dólares por millón de tokens de salida. Ese nivel de coste no es una nota secundaria: es una condición para que este tipo de experiencias puedan escalar. Una web generada en tiempo real para cada usuario sería prohibitiva si dependiera solo de modelos caros o lentos. La apuesta de Google consiste precisamente en combinar suficiente inteligencia con costes y tiempos de respuesta compatibles con productos de uso intensivo.

Conviene entender lo que eso significa en términos de producto. La IA generativa empezó como una capa extraordinaria: algo a lo que el usuario acudía para resolver una tarea concreta. Flash-Lite apunta a otra etapa, una en la que la IA se vuelve infraestructura discreta y omnipresente. Si un navegador puede regenerar páginas sobre la marcha, entonces el usuario no necesariamente “usa” un modelo de IA de forma explícita; simplemente habita una interfaz modelada por él. La latencia deja de ser una cuestión puramente ingenieril y se convierte en condición psicológica para que la IA desaparezca dentro de la experiencia.

Esa lógica explica también la insistencia de Google en que el modelo sea bueno siguiendo instrucciones y usando herramientas. En la ficha técnica, Flash-Lite aparece con soporte para function calling, structured output, search as a tool y code execution. En paralelo, la documentación para desarrolladores lo presenta como una pieza útil para enrutar tareas según su complejidad, un patrón que Google dice que ya usa el proyecto open source Gemini CLI para clasificar solicitudes y decidir si deben resolverse con Flash o con Pro. No estamos, por tanto, ante un modelo rápido a secas, sino ante una pieza pensada para orquestar productos donde velocidad, estructura y ejecución importan tanto como el contenido.

La propia DeepMind refuerza esta lectura con testimonios de socios tempranos. En la página del modelo, Latitude afirma que 3.1 Flash-Lite ha logrado una tasa de éxito un 20% superior y tiempos de inferencia un 60% más rápidos que su modelo anterior. Cartwheel destaca su velocidad y su capacidad de seguir instrucciones, especialmente en exploración de código y etiquetado multimodal a gran escala. HubX habla de completados por debajo de diez segundos, cumplimiento estructurado cercano al 97% y precisión de enrutamiento de intención del 94%. Más allá del lenguaje promocional, todos esos ejemplos apuntan en la misma dirección: la utilidad del modelo se mide en sistemas de producción donde importa sostener frecuencia, formato y consistencia.

Ese contexto hace que la demo del navegador pueda leerse como algo más ambicioso que una simple exhibición de rapidez. En realidad, funciona como una declaración sobre cómo Google imagina la próxima web: menos dependiente de páginas fijas y más cercana a interfaces generativas capaces de ensamblar contenido y estructura sobre la marcha. Eso podría tener efectos muy amplios. Para desarrolladores, significa reducir la fricción entre idea y prototipo. Para empresas, abre la puerta a experiencias más personalizadas y contextuales. Para usuarios, puede implicar una navegación más maleable, donde la web se reorganiza según intención y contexto, no solo según menús predefinidos. Todo eso, claro, dependerá de que la velocidad y el coste aguanten a escala.

También hay que mirar la otra cara del movimiento. Una web generada al vuelo por IA introduce preguntas serias sobre consistencia, trazabilidad y control. Cuando una página es el resultado de una generación en tiempo real, ¿qué parte de su contenido está fija y cuál es mutable? ¿Cómo se auditan errores, sesgos o alucinaciones visuales y estructurales en una interfaz que no siempre será exactamente igual? ¿Cómo se preservan estándares de accesibilidad, rendimiento y confianza si la capa de presentación deja de ser estable? El vídeo de demostración no responde a esas preguntas, pero precisamente por eso las vuelve más urgentes. La latencia puede haber empezado a resolverse, pero la gobernanza de estas interfaces aún está muy abierta.

Hay además una cuestión estratégica de fondo. En el mercado actual de IA, no basta con tener modelos potentes; hace falta insertarlos en formas de uso nativas. OpenAI, Anthropic, Microsoft y Google compiten por demostrar no solo qué modelo razona mejor, sino qué experiencia de producto puede construirse alrededor de él. El navegador experimental de Flash-Lite es una jugada de posicionamiento en esa dirección. Google no está diciendo únicamente “nuestro modelo es rápido”; está diciendo “nuestra velocidad permite nuevas superficies de interacción”. Esa es una diferencia importante, porque desplaza la conversación desde los benchmarks abstractos hacia el terreno mucho más decisivo del producto.

La elección del término “Flash-Lite” también cobra aquí un sentido más preciso. Google quiere asociar este modelo a la idea de frecuencia, ligereza operativa y presencia continua. No es el modelo para el gran ensayo ni para el razonamiento más pesado, aunque sus métricas sean competitivas dentro de su segmento; es el modelo para estar en todas partes sin encarecer la experiencia. De hecho, la compañía lo describe como “best for high-volume tasks that need efficiency and intelligence”. Traducido al terreno del navegador experimental, eso significa una IA que no bloquea la interacción, sino que la acompaña con suficiente rapidez como para reconfigurarla en vivo.

El efecto cultural de esto tampoco debería subestimarse. Durante años, la creación web se repartió entre plantillas, frameworks, CMS y herramientas de diseño visual. La irrupción de modelos capaces de generar interfaces completas ya había empezado a tensionar ese ecosistema. Pero una interfaz que se crea mientras navegas va un paso más allá: convierte la web en un medio menos publicado y más sintetizado. No elimina el desarrollo tradicional, pero sí sugiere que parte del valor se desplazará desde la construcción manual de páginas hacia el diseño de sistemas, restricciones, estilos y reglas de generación. Es un cambio que recuerda a otras transiciones tecnológicas: primero se automatiza la ejecución, luego se redefine el trabajo humano alrededor de la supervisión y la arquitectura.

Por supuesto, todavía estamos en fase de demostración y vista previa. Google presenta 3.1 Flash-Lite en preview, y el navegador experimental asociado aparece como una muestra de lo que la velocidad del modelo hace posible, no como un producto de consumo consolidado. Ese matiz importa. La distancia entre demo convincente y adopción masiva suele ser grande, especialmente cuando intervienen rendimiento, seguridad, coste y expectativas de usuario. Pero también es cierto que muchas de las categorías de producto más influyentes de la IA reciente empezaron así: como demostraciones que parecían marginales y acabaron reordenando las interfaces.

En el fondo, la demostración de Gemini 3.1 Flash-Lite deja una idea bastante clara. La siguiente gran batalla de la IA no se librará solo en quién produce el mejor texto o el mejor código, sino en quién logra que esa inteligencia se incorpore a la experiencia digital con la menor fricción posible. Cuando la velocidad es suficiente, la IA deja de sentirse como una consulta y empieza a parecer parte del tejido mismo de la navegación. Y si eso ocurre, la web puede dejar de ser solo algo que visitamos para convertirse en algo que se compone delante de nosotros mientras pensamos, buscamos y avanzamos.