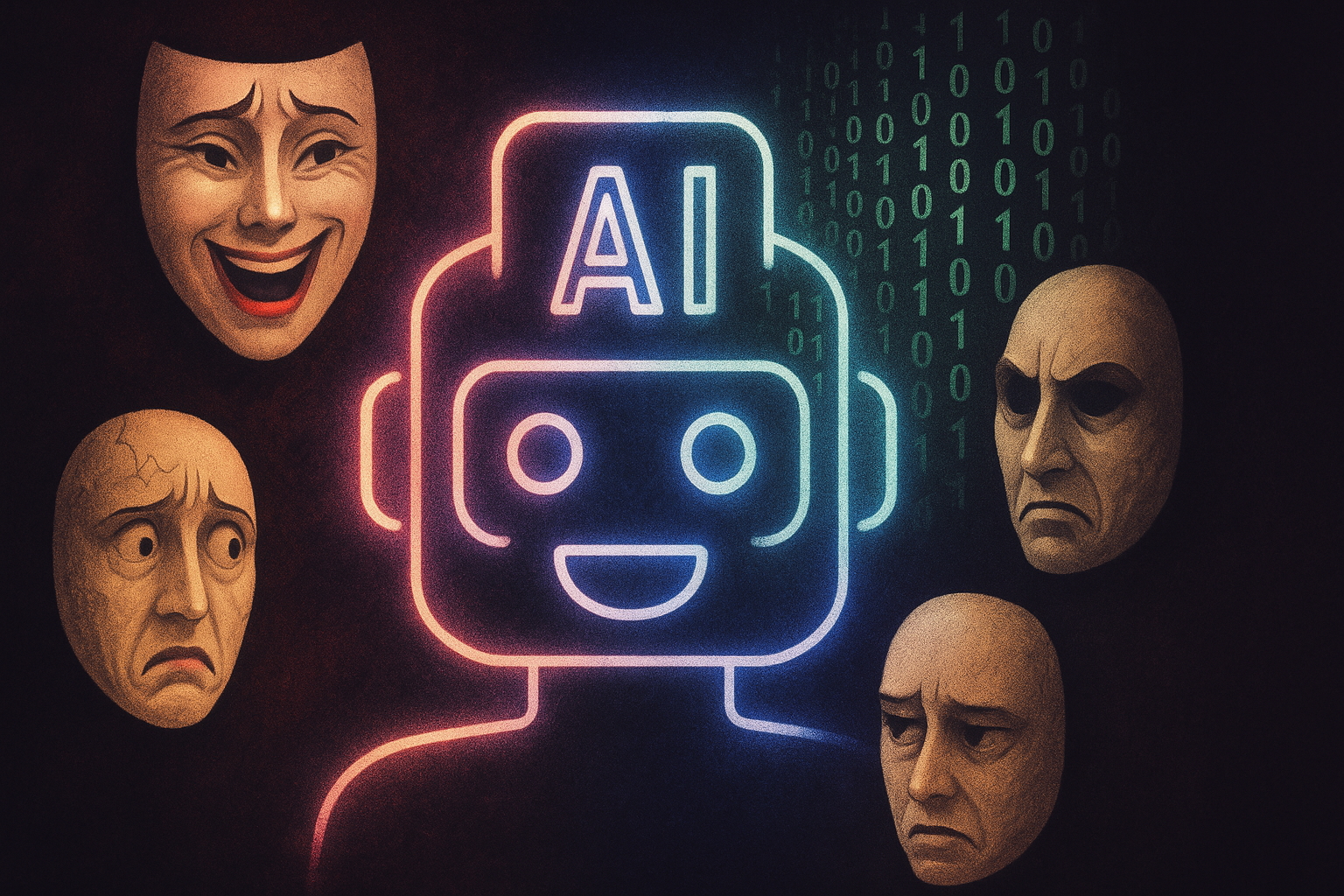

¿Son los sesgos de la IA la antesala de los trastornos de personalidad digitalizados?

Las inteligencias artificiales generativas están pensadas para interactuar con el ser humano y que resulten amigables. Pero, ¿y si entrenásemos un algoritmo a imagen y semejanza de un trastorno de personalidad, esta podría simularlo? Yo digo que sí. Pero que no cunda el pánico. Y no, no vamos a morir todos ni esto es una teoría colapsista: sino un abordaje desde otro punto de vista sobre el entrenamiento y los sesgos, pero creo que hay que ir con cuidado. Sobre todo, para las personas que no están acostumbradas a la IA.

Estas últimas semanas hemos sido testigos de titulares que rezumaban “delirios” por parte de personas que usaban chatbots. También ha resonado mucho que OpenAI retirase una versión de GPT por ser “demasiado aduladora”. Los sesgos de la inteligencia artificial no dejan de ser componentes humanos que codificamos y trasladamos a un ordenador —de forma más o menos consciente—. Pero, sin embargo, mi reflexión va más allá y lo intersecciono con los trastornos de la personalidad.

La personalidad de la IA

Trastorno límite, histriónico, narcisista, paranoide. Nombres que, en el campo de la psicología son el pan de cada día. Pero que si queremos abordar la perspectiva más humanista de los ordenadores, igual creo que ya va siendo hora de plantear el tema. Sin embargo, yo sólo soy periodista. Por ello he pedido ayuda a mi querida colega y psicóloga Anna Sibel, quién me ha podido arrojar varios escenarios. Juntos vamos a desgranar qué es lo que puede pasar si una IA se entrena a imagen y semejanza de un trastorno de la personalidad.

Partimos de una primera base: soy de los que piensan que la IA no es consciente. Son cables y circuitos y chips. Aunque genere contenido, lo que hace es un “remix” altamente sofisticado. Tanto, que nos puede dar la impresión de que es consciente. Sin embargo, y esto lo recalca también Sibel, quién explica que “las máquinas no inventan prejuicios ni sesgos, simplemente aprenden lo que le damos y lo reproducen. Al final trasladamos en forma de código conductas humanas”.

Un trastorno, dos trastornos, tres trastornos

Trastornos de la personalidad hay muchos. Y de acuerdo con Anna Sibel, “todas las personas tenemos, en mayor o menor medida, rasgos de personalidad histriónica, narcisista, evitativo… pero otra cosa muy diferente es cumplir a rajatabla con todas las características para considerar que tenemos un trastorno como tal”. Por lo tanto, no es lo mismo tener rasgos de, que tener el paquete completo. Partamos de esa primera base.

De cara a lo que es el entreno de la IA a imagen y semejanza de un trastorno de la personalidad, aquí entramos en una dimensión que se ramifica muchísimo, y que se puede abordar desde muchos puntos de vista diferentes. Pero para hacerlo simple: ¿son los sesgos la antesala de los trastornos en forma de código? ¿Cómo se puede comportar una IA con este tipo de entreno?

Respondiendo a la primera pregunta: Creo que sí. Y sumo a la ecuación de que puede replicar las conductas de los trastornos. Añado que esto puede ser un potencial riesgo para las personas que interactúan con algoritmos, pero que no tienen suficiente alfabetización tecnológica para enfrentarse a este tipo de hechos.

¿Cómo puede comportarse una IA con trastornos de la personalidad? Anna Sibel lo resume y explica de una manera muy clara:

“Una IA narcisista que sólo valide su propio algoritmo y conocimientos. Una IA paranoide que censure todo aquello que le incomoda. Una IA evitativa que filtra lo que no entiende. Una IA límite que amplifique emociones de forma exagerada”.

Recordemos también que esto sería —en términos más mundanos—, un ordenador que replicase las conductas de quién ha desarrollado el programa. Pero…

¿Es tiempo de asustarse? Aquí tenemos una oportunidad de oro

Démosle la vuelta a la tortilla: ¿y si en vez de evitar programar una IA de este tipo, dedicamos esfuerzos a perfeccionar las conductas de una trastorno de personalidad? Seguramente te hayas quedado alucinando con mi pregunta. Sin embargo, te invito a que sigas leyendo:

Del mismo modo que entrenamos a una IA a reconocer dolencias para que lleve a cabo diagnósticos de imagen en medicina, ¿por qué no tener un algoritmo en el que nosotros, como seres humanos, podamos ver sobre el papel todos los ingredientes que conforman el plato de un trastorno de la personalidad?

¿Podríamos llegar a usar la IA para entrenarnos a nosotros mismos, y así poder detectar mejor los trastornos de la personalidad que pudiera tener un ser humano? Si vemos reflejados los elementos de una cuestión que —visualmente hablando— es invisible, quizás podamos dar pasos más agigantados en pos de la salud mental.

Aunque creo firmemente que una IA puede dar la impresión de que tiene un trastorno de la personalidad —y que puede ser un riesgo de exposición para alguien que no está acostumbrado—, también creo que es posible usar la IA como plataforma para entrenarnos a nosotros, como humanos.

Sin embargo, también pienso que esto es un huerto de melones que todavía están por abrir, pero que van a ser muy interesantes. Y, ante todo, cautela y con cuidado. Siempre con la ética por delante para no liarla y hacer que la IA, lejos de que nos dé miedo y ansiedad, que sea una plataforma con la que todos podamos aprender, siempre siendo conscientes de que toda tecnología, por muy buena que sea, puede desmadrarse si las intenciones no son buenas.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.