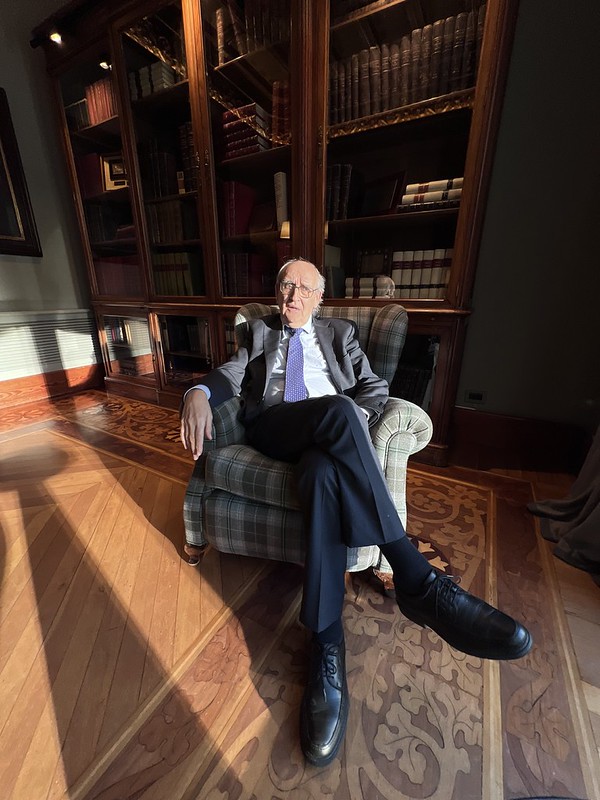

Antoni Garrell, ingeniero industrial especialista en innovación y economía del conocimiento: “La IA nos superará y podemos dejar de ser la única inteligencia del planeta”.

Antoni Garrell i Guiu (L’Espluga de Francolí, 1953) es ingeniero industrial y economista, autor de una tesis sobre inteligencia artificial —sistemas automáticos de toma de decisión— en 1995, miembro de honor de la Real Academia Europea de Doctores y autor de su décimo libro, La segunda revolución digital: una nueva era para la humanidad. En esta entrevista nuestro colaborador en Paréntesis MEDia reflexiona sobre el cambio de era que implica la inteligencia artificial, los riesgos de una sociedad excesivamente dependiente de la tecnología, el papel de Europa en la nueva economía digital y los retos educativos y políticos que plantea esta transformación.

Acaba de publicar su décimo libro. ¿Cómo nace este proyecto y qué pretende explicar?

Este libro hay que entenderlo en relación con los dos anteriores. El penúltimo estaba dedicado a la industria 4.0, pero entendida como productos y servicios inteligentes. Y el anterior intentaba explicar qué representa realmente esta industria 4.0.

Cuando analizas qué significa introducir inteligencia en los productos, llegas a una idea muy clara: añadir sensores o automatismos es relativamente fácil. Un sensor que detecta el paso de una persona ya es, en cierta manera, un elemento inteligente. Pero hay un salto enorme entre eso y la capacidad de tomar decisiones considerando múltiples factores.

El libro nace de esta reflexión. ¿Qué significa realmente que los productos y los servicios sean inteligentes? Y cuando analizas este fenómeno en profundidad te das cuenta de que la humanidad está entrando en una nueva era.

El problema es que no somos conscientes. Avanzamos muy rápido, pero sin reflexionar lo suficiente sobre lo que implica este cambio.

El libro no pretende dar respuestas definitivas; lo que intenta es justificar por qué estamos entrando en una nueva etapa de la humanidad y abrir un conjunto de reflexiones que deberíamos hacer si no queremos que esta nueva era nos pase por encima como un tsunami.

¿Cree que la sociedad no es consciente de la magnitud de este cambio?

Hay dos factores.

El primero es la sensación de que el tiempo se ha acelerado. Recibimos más información de la que nuestro cerebro es capaz de procesar. Esto genera la percepción de que todo pasa muy rápido.

Algunos incluso dicen que la Tierra gira más rápido. Puede que haya alguna pequeña variación, pero es mínima. El problema real es que la cantidad de información que recibimos supera nuestra capacidad cognitiva.

Pero hay un segundo factor mucho más profundo.

Nuestra educación, nuestra formación y las herramientas mentales que utilizamos para interactuar con el mundo eran válidas hace diez años. Hoy ya no lo son.

Seguimos utilizando patrones mentales que han quedado obsoletos. Y eso hace que no seamos conscientes del cambio que estamos viviendo.

“No somos conscientes de que estamos entrando en una nueva era de la humanidad y que las herramientas mentales y educativas ya no sirven”.

¿Tiene algún ejemplo que ilustre esta dependencia tecnológica?

Sí. Un ejemplo muy sencillo.

Más del 80% de las personas menores de 35 años no saben leer un mapa.

Si dejas a alguien en medio de Barcelona sin móvil, sin navegador, sin GPS, es muy probable que no sepa orientarse hacia el Tibidabo, hacia Montjuïc, hacia el Maresme o hacia el Garraf.

Esto puede parecer anecdótico, pero no lo es.

Los navegadores funcionan con satélites. Si algún día estos sistemas fallan, ¿qué haremos?

El problema es que lo que no practicas también lo pierdes.

Estamos avanzando hacia una sociedad que depende completamente de sistemas tecnológicos mientras olvidamos habilidades básicas.

Eso significa que estamos construyendo un mundo que funciona… mientras todo funciona.

¿Cómo se puede afrontar este cambio de era?

Hay tres pasos esenciales.

Primero: entender qué pasa, por qué pasa y qué puede pasar.

Segundo: asumir que los sistemas pueden fallar y tener alternativas.

Tercero: no dejar de aprender aquellas habilidades que nos permiten actuar cuando la tecnología no funciona.

Tomar conciencia es el primer paso imprescindible.

¿Esta falta de conciencia es responsabilidad de los ciudadanos, de los gobiernos o de las instituciones?

Es un problema compartido, pero hay tres factores clave.

El primero es la formación. El sistema educativo sigue siendo esencialmente analógico. No hemos adaptado la educación a la era digital.

El segundo es económico y social. Algunos países entendieron la tecnología como una herramienta de competitividad y también de poder. Europa, en cambio, quedó un poco al margen de esta carrera.

Hoy la economía digital está dominada esencialmente por empresas norteamericanas.

Y eso tiene consecuencias enormes.

Las plataformas digitales eliminan intermediarios y concentran el valor en un único punto de la cadena. Si ese punto está fuera de tu territorio, también lo están los beneficios y los impuestos.

Eso debilita la economía local y pone en riesgo el modelo de estado del bienestar.

El tercer factor es la política. Los gobiernos trabajan con horizontes muy cortos. Las decisiones se toman pensando en las siguientes elecciones. Pero los cambios tecnológicos requieren estrategias a largo plazo.

La tecnología es cada vez más transversal. ¿Eso cambia también el modelo de innovación?

Sí.

Las tecnologías más transformadoras son herramientas transversales que pueden servir para muchas cosas.

Un ejemplo muy claro es ChatGPT.

Sirve para resolver problemas matemáticos, para hacer diagnósticos preliminares, para escribir poesía o para redactar informes.

Es una herramienta horizontal que cada usuario adapta a sus necesidades.

Esta es la nueva lógica de la tecnología: herramientas concebidas de forma transversal que luego se personalizan según el uso.

En el libro defienden que prohibir no es la solución a los riesgos tecnológicos.

Prohibir solo funciona en ecosistemas completamente cerrados. Y el mundo digital no lo es.

Siempre habrá formas de esquivar las restricciones.

Por eso la clave no es prohibir sino educar.

Hay que enseñar a utilizar la tecnología correctamente.

Internet es una herramienta extraordinaria para acceder al conocimiento. Pero debemos educar para que se utilice con criterio.

Hay que aprender a distinguir entre información fiable y manipulación.

¿Cómo ve el futuro de Europa en la carrera tecnológica global?

Si respondo con la primera intuición, diría que Europa vive una segunda decadencia romana.

Europa representa aproximadamente el 7% de la población mundial pero concentra casi el 50% del gasto social del planeta.

Este modelo no es sostenible si no generamos más capacidad económica y tecnológica.

Europa tiene un PIB enorme, tiene capacidad científica y talento. Pero no sabe transformar ese conocimiento en innovación económica.

Es lo que se conoce como la paradoja europea.

¿Informes como el de Mario Draghi apuntan a una solución?

Sí.

Draghi identifica claramente el problema: tenemos capacidad científica pero no sabemos convertirla en innovación.

Europa debe apostar por la tecnología, por la digitalización y por la inteligencia artificial.

Pero también debe concentrar esfuerzos.

No todos los países pueden ser líderes en todo.

Hace falta especialización y coordinación.

¿Qué papel pueden tener Catalunya y Barcelona en la IA?

Catalunya tiene una base muy sólida.

Hace más de treinta años ya había proyectos de IA vinculados a universidades y centros de investigación.

También tenemos centros muy importantes en robótica e inteligencia artificial.

El problema no es la capacidad científica.

El problema es que a menudo no sabemos transformar ese conocimiento en aplicaciones reales.

Hay que creérselo, invertir y concentrar esfuerzos.

En el libro habla a menudo de paradojas tecnológicas.

Sí.

Los periodos de transición siempre están llenos de paradojas.

Un ejemplo es la regulación.

Europa regula mucho. Regular puede ser necesario. Pero la clave no es solo regular.

La clave es avanzar con una estrategia clara.

“Prohibir no resuelve nada en el mundo digital; lo que hace falta es educar para utilizar la tecnología en beneficio del progreso económico y social”.

¿Cree que la inteligencia artificial puede superarnos?

Sí.

Y puede hacerlo relativamente pronto.

Nuestra sociedad está muy orientada al proceso: contabilidad, derecho, gestión administrativa.

En el proceso, un ordenador siempre será mejor que nosotros.

Por eso la IA puede superarnos no solo en cálculo, sino en formas de pensamiento.

¿Cuándo podría llegar una superinteligencia artificial?

Entre cinco y diez años.

Todo dependerá de los recursos que se sigan invirtiendo.

¿Existe el riesgo de una burbuja de la inteligencia artificial?

Sí, pero no me preocupa demasiado.

Cuando apareció internet también se hablaba de la burbuja de las puntocom.

La burbuja llegó y mucha gente perdió dinero.

Pero internet no desapareció. Al contrario, se consolidó con más fuerza.

Con la inteligencia artificial pasará algo similar.

Habrá inversiones fallidas, pero la tecnología seguirá avanzando.

También apunta riesgos en el uso cotidiano de la tecnología. ¿Estamos banalizando los riesgos?

Sí, absolutamente.

Vivimos en una especie de falsa sensación de seguridad.

Sabemos que hay problemas de ciberseguridad, sabemos que determinadas plataformas pueden ser adictivas o perjudiciales —especialmente en edades críticas como la adolescencia—, y aun así seguimos utilizándolas como si no pasara nada.

Pensemos en el caso de TikTok, por ejemplo. Hay evidencia de que puede generar dependencia y afectar al desarrollo cognitivo en determinadas etapas, y aun así su uso está completamente normalizado.

Lo mismo ocurre con la ciberseguridad.

Somos conscientes de los riesgos, pero seguimos actuando como si los sistemas fueran infalibles.

El problema es que avanzamos en un entorno digital que damos por garantizado, cuando en realidad es mucho más frágil de lo que parece.

Y eso refuerza aún más la idea de que estamos entrando en una nueva era sin ser plenamente conscientes.

También habla de manipulación y de los valores detrás de la tecnología. ¿Hasta qué punto la IA puede estar condicionada?

Este es un tema clave.

Cuando hablamos de inteligencia artificial, a menudo nos centramos en su capacidad técnica, pero olvidamos que estas herramientas dependen de su proceso de aprendizaje.

Y aquí los datos y la cultura que hay detrás son fundamentales.

La IA no es neutra.

Lleva implícitos unos valores, unos criterios y una manera de entender el mundo.

Eso abre la puerta no solo a errores, sino también a la manipulación.

Por eso es tan importante diferenciar entre una tecnología ética y una que no lo es.

Y aquí aparece otro debate fundamental: hasta dónde debemos regular.

La regulación es necesaria, pero no es suficiente.

Lo realmente importante es entender cómo funcionan estas herramientas y qué valores llevan incorporados.