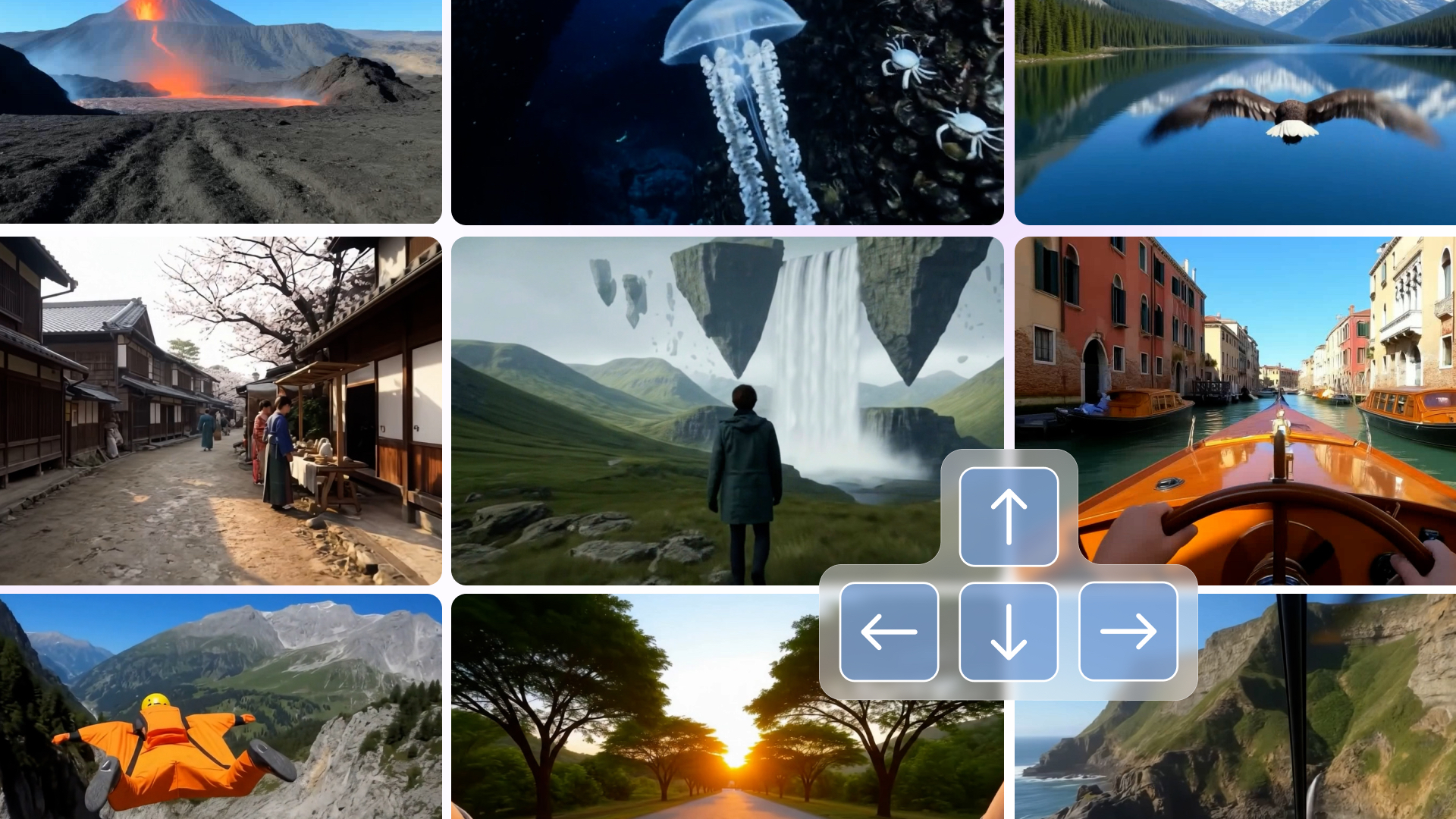

DeepMind ha presentado Genie 3, un modelo capaz de generar entornos interactivos en tiempo real a partir de descripciones textuales. Lo hace con una coherencia visual que se mantiene durante varios minutos, como si improvisara un mundo con memoria.

Mundos que se despliegan como si estuvieran vivos

Genie 3 funciona con un modelo generativo autoregresivo, una arquitectura que predice cada fotograma del entorno en secuencia, en calidad 720p y a 24 cuadros por segundo. Es decir, genera los mundos paso a paso, como si estuviera improvisando una película a medida que avanza. A diferencia de Genie 2 —que solo podía sostener la coherencia visual durante unos veinte segundos—, esta nueva versión mantiene la posición de objetos, la lógica espacial y la continuidad del escenario durante varios minutos seguidos.

Cambiar el clima con una frase escrita

Una de las claves está en los llamados «eventos promptables en el mundo», unos comandos de texto que modifican el entorno sin interrumpir la simulación. Puedes pedir que caiga la noche, que aparezca un personaje o que empiece a llover. DeepMind plantea esto como una forma de crear escenarios contrafactuales, útiles para entrenar agentes virtuales que aprenden por ensayo y error.

Sin geometría 3D, sin datos etiquetados

El sistema no se apoya en estructuras tridimensionales como NeRFs o Gaussian Splatting. Cada mundo se genera mediante un modelo de vídeo entrenado con datos sin etiquetar. Internamente, combina un modelo espacial-temporal y un espacio de acción latente: una forma de codificar lo que un agente puede hacer, sin necesidad de definirlo paso a paso.

Los límites también tienen forma

El potencial es evidente, pero también lo son sus límites. Los agentes solo pueden realizar un conjunto reducido de acciones. Las simulaciones con varios personajes aún tropiezan. Aunque los objetos mantienen su posición durante minutos, el sistema no logra simular entornos reales con precisión. Y el texto en pantalla rara vez es legible, salvo que se describa letra por letra.

De los videojuegos al entrenamiento de máquinas

Genie 3 mejora con claridad respecto a Genie 2, que apenas ofrecía escenarios breves. También se distingue de modelos como Veo 3, centrado en generar vídeo sin interacción. Aquí, la clave es la persistencia interactiva. DeepMind ha reunido un equipo específico para esta línea, dirigido por Tim Brooks, con aplicaciones previstas en videojuegos, robótica y entornos de entrenamiento para IA.

Una escena que espera personajes

Genie 3 propone que un texto pueda convertirse en un mundo que se camina. Una escena que no solo se ve, sino que responde. Pero también evidencia que falta una coherencia a largo plazo, libertad de acción, espacios con vida propia. El avance es real, pero el terreno que se abre aún no tiene caminos marcados.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.