El dilema emergente de la autonomía letal

El constante avance tecnológico nos sitúa en el umbral de una nueva era en múltiples dominios, y la esfera de la defensa y la seguridad no es una excepción. En este contexto, emerge con fuerza un concepto que hasta hace poco parecía relegado a la ciencia ficción: los Sistemas de Armas Autónomas Letales (LAWS, por sus siglas en inglés). Estos sistemas representan un cambio de paradigma, ya que, una vez activados, poseen la capacidad inherente de seleccionar y atacar objetivos sin necesidad de una intervención humana directa en la decisión final. Este desarrollo plantea un desafío formidable y complejo, que va más allá de lo puramente técnico para adentrarse en profundas consideraciones éticas, legales y estratégicas a nivel global.

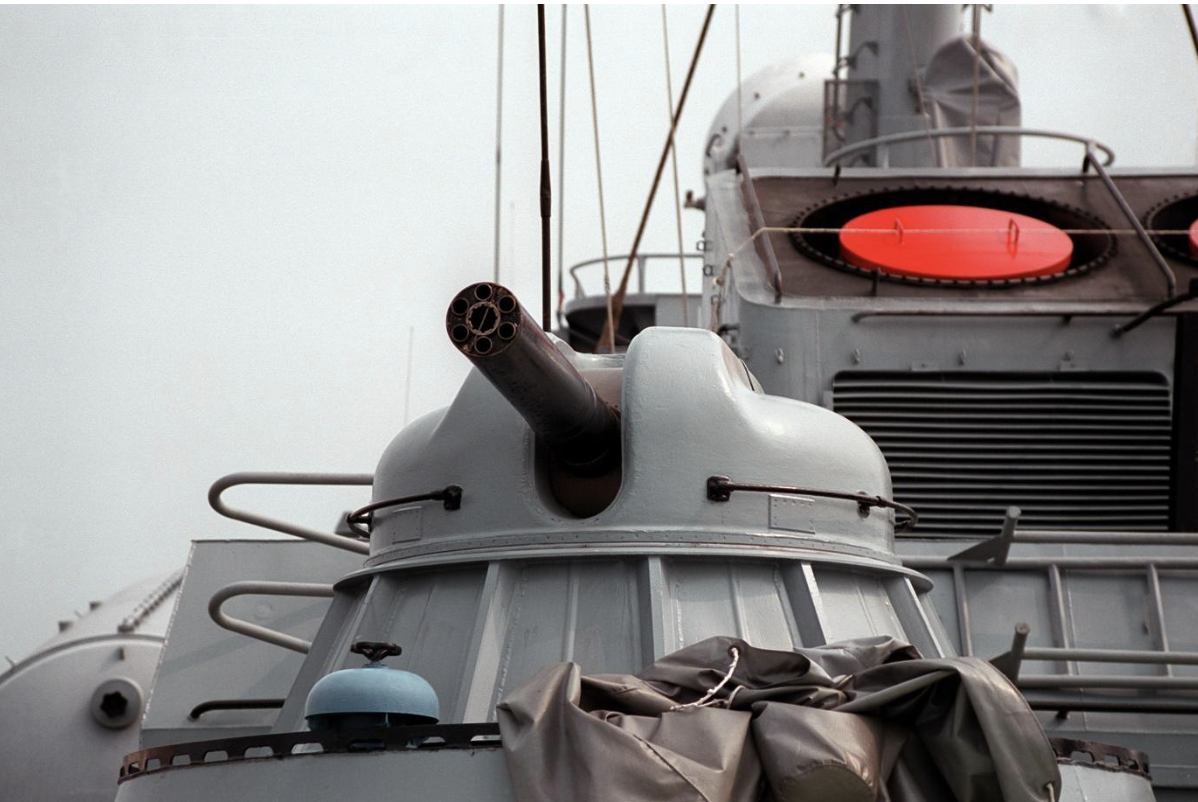

AK-630 Naval gun 30 mm cannon, Gobierno de EE. UU., dominio público.

La «solución» que da origen a estas capacidades sin precedentes es una intrincada simbiosis tecnológica. Por un lado, encontramos la Inteligencia Artificial (IA), y más concretamente sus subcampos del aprendizaje automático (machine learning) y el aprendizaje profundo (deep learning), como el motor cognitivo. Estos algoritmos permiten a las máquinas procesar ingentes cantidades de datos, aprender de ellos y, en última instancia, tomar decisiones complejas. Por otro lado, esta «inteligencia» se materializa y opera a través de plataformas robóticas avanzadas —— equipadas con un sofisticado arsenal de sensores (cámaras de alta resolución, radares, LiDAR) que les permiten percibir e interpretar su entorno con una granularidad creciente. Es la fusión de estas capacidades de percepción, procesamiento y acción autónoma la que redefine el campo de batalla y nos compele a analizar sus vastas implicaciones.

IA: el cerebro digital que potencia la autonomía armada

La verdadera revolución que suponen los sistemas de armas autónomas no reside únicamente en la sofisticación de sus componentes físicos, sino en la inteligencia que los gobierna. Es la sinergia entre la Inteligencia Artificial, actuando como un cerebro digital avanzado, y las plataformas robóticas y sensoriales, lo que desbloquea un potencial transformador. Esta combinación permite que las máquinas no solo ejecuten tareas preprogramadas, sino que perciban su entorno, comprendan situaciones complejas, tomen decisiones y actúen con un grado de autonomía que desafía las concepciones tradicionales de la guerra. La capacidad de adaptación en tiempo real y la toma de decisiones a velocidades sobrehumanas en escenarios dinámicos son cruciales en el dominio de la defensa. Más adelante, exploraremos ejemplos concretos de cómo esta unión se materializa, por ejemplo, en el desarrollo de enjambres de drones coordinados o sistemas defensivos capaces de neutralizar amenazas de forma autónoma.

DARPA, dominio público (derivada de DARPA Strategic Plan (2007).pdf).

Para comprender esta sinergia, es fundamental detallar el papel de la Inteligencia Artificial (IA) como el elemento catalizador. La IA, en su concepción más amplia, busca replicar o simular procesos cognitivos humanos en máquinas. Si bien sus orígenes se remontan a mediados del siglo XX, su explosión reciente y su aplicabilidad en sistemas autónomos se deben fundamentalmente al auge del Aprendizaje Automático (Machine Learning, ML) y, dentro de este, al Aprendizaje Profundo (Deep Learning, DL). Estos enfoques han supuesto un cambio de paradigma: en lugar de programar explícitamente cada posible acción ante cada contingencia, se diseñan algoritmos que «aprenden» a partir de grandes cantidades de datos.

El Aprendizaje Automático permite a los sistemas identificar patrones, realizar predicciones y tomar decisiones tras ser entrenados con datos relevantes, sin necesidad de instrucciones específicas para cada caso. El Aprendizaje Profundo va un paso más allá, utilizando arquitecturas de redes neuronales con múltiples capas –inspiradas vagamente en la estructura del cerebro humano– para procesar información compleja, como imágenes, señales de radar o texto, y extraer de forma automática las características más relevantes para una tarea. Por sí sola, antes de integrarse en una plataforma física, la IA puede analizar datos de inteligencia para identificar patrones de actividad, clasificar objetos en imágenes satelitales o detectar anomalías en las comunicaciones. Sin embargo, también presenta limitaciones inherentes, como la dependencia de la calidad y cantidad de los datos de entrenamiento, la posibilidad de heredar sesgos presentes en dichos datos y la dificultad, en ocasiones, de interpretar cómo llegan a una determinada conclusión (el desafío de la «caja negra» o la necesidad de IA Explicable).

Plataformas robóticas y sensores avanzados: los «sentidos y músculos» de la IA en el campo de batalla

La inteligencia artificial, por sí sola, es un potente motor de análisis y decisión, pero para interactuar y ejercer influencia en el mundo físico, necesita «sentidos» para percibirlo y «músculos» para actuar. Este es el papel crucial que desempeñan las plataformas robóticas avanzadas y sus sofisticados conjuntos de sensores. Hablamos de vehículos aéreos no tripulados (UAVs o drones) capaces de realizar misiones de reconocimiento, vigilancia y ataque; vehículos terrestres no tripulados (UGVs) diseñados para patrullar o neutralizar explosivos; o sistemas de defensa automatizados como los CIWS (Close-In Weapon Systems) embarcados, que detectan y abaten misiles entrantes de forma autónoma. Estas plataformas son la materialización de los algoritmos.

Robot militar Imagen: Ejército de EE. UU.

La interacción entre la IA y estas plataformas es intrínseca. Los sensores –que incluyen cámaras ópticas e infrarrojas, radares, LiDAR (Light Detection and Ranging) y unidades de medición inercial (IMU)– recopilan un flujo masivo y constante de datos del entorno. La IA procesa esta información sensorial, a menudo directamente a bordo de la plataforma gracias al «procesamiento en el borde» (Edge AI). Esta capacidad de análisis local es vital, ya que permite tomar decisiones en tiempo real con mínima latencia y operar incluso si se pierden las comunicaciones con un control central. Así, las «comprensiones» y «decisiones» generadas por los modelos de IA se traducen en acciones concretas: un dron ajusta su ruta, un UGV identifica un posible objetivo, o un sistema de defensa activa sus contramedidas.

La combinación de IA con estas plataformas robóticas y sensoriales añade capacidades transformadoras. Destaca la fusión de sensores, donde la IA integra inteligentemente los datos de múltiples fuentes para crear una conciencia situacional unificada, precisa y robusta, superando las limitaciones de cualquier sensor individual. Esto permite una navegación autónoma más segura en terrenos desconocidos (utilizando técnicas como SLAM mejorado por IA), una identificación y seguimiento de blancos más eficaz y, en última instancia, la ejecución de misiones complejas con una intervención humana significativamente reducida o, en el caso de los LAWS, potencialmente ausente en la fase de ataque. Es esta capacidad de otorgar autonomía letal a las máquinas lo que marca un punto de inflexión, haciendo de esta sinergia tecnológica un desarrollo novedoso y profundamente disruptivo en la historia del armamento.

Las municiones merodeadoras como paradigma de la autonomía letal inteligente

Para ilustrar de manera concreta cómo la Inteligencia Artificial y las plataformas robóticas avanzadas convergen en el ámbito militar, podemos analizar el caso de las municiones merodeadoras, también conocidas como drones suicidas o kamikaze. Estos sistemas abordan el desafío de mantener una presencia persistente sobre un área de interés, identificar objetivos de oportunidad que puedan surgir y neutralizarlos rápidamente, incluso en entornos donde las comunicaciones son intermitentes o denegadas.

IAI Harpy en el Paris Air Show. Foto de Jastrow, dominio público, vía Wikimedia Commons.

En su funcionamiento, una munición merodeadora —esencialmente un vehículo aéreo no tripulado (UAV) compacto cargado de explosivos— es lanzada hacia una zona designada. Una vez allí, entra en juego la sinergia A+B: la plataforma (B), equipada con sensores electroópticos e infrarrojos (EO/IR), transmite datos en tiempo real. Los algoritmos de Inteligencia Artificial (A) a bordo, a menudo apoyados por procesamiento en el borde (Edge AI), son cruciales. Estos algoritmos de aprendizaje automático, entrenados previamente con vastas bibliotecas de imágenes y signaturas de objetivos, permiten al sistema realizar una navegación autónoma mientras «merodea» o sobrevuela la zona. Más importante aún, la IA se encarga de la visión por computadora para escanear continuamente el terreno, detectar, clasificar e identificar posibles blancos (vehículos, estructuras, personal) basándose en los parámetros de la misión.

Una vez que un objetivo válido es identificado y confirmado (ya sea de forma completamente autónoma por el sistema o tras una validación humana remota, dependiendo del nivel de autonomía configurado y las reglas de enfrentamiento), la munición puede iniciar el ataque, impactando directamente contra el blanco. Los resultados clave de esta aplicación incluyen una capacidad de vigilancia y respuesta rápida sobre un área extendida, la reducción del riesgo para las fuerzas propias (al no exponer personal en la búsqueda directa del objetivo) y la posibilidad de operar con alta precisión. Si bien la validación de estos sistemas implica rigurosas pruebas en entornos simulados y reales para asegurar la fiabilidad en la detección, clasificación y minimización de errores, uno de los desafíos persistentes es garantizar la robustez de la IA ante contramedidas o escenarios no previstos, así como asegurar un control humano significativo en ciclos de decisión que pueden ser extremadamente rápidos.

El horizonte extendido de la autonomía inteligente y su contexto global

Si bien las municiones merodeadoras ofrecen un ejemplo contundente, el potencial de la sinergia entre Inteligencia Artificial y robótica avanzada se extiende a un abanico mucho más amplio de aplicaciones militares. Pensemos en vehículos terrestres no tripulados (UGVs) capaces de realizar misiones de patrulla, desactivación de explosivos o incluso tareas logísticas en zonas de combate de forma autónoma. Los sistemas de defensa, como las torretas navales CIWS que identifican y neutralizan amenazas misilísticas en segundos, también se benefician enormemente de la velocidad y precisión de la IA. Asimismo, se investiga intensamente el concepto de «enjambres» de drones, donde múltiples unidades aéreas o terrestres, coordinadas por IA, podrían colaborar para realizar misiones complejas de vigilancia, reconocimiento o incluso saturación de defensas.

Imagen originalmente publicado en Ainonline.com

El desarrollo y la potencial proliferación de estas tecnologías son un fenómeno de alcance global, lo que ha impulsado un intenso debate en foros internacionales, incluyendo las Naciones Unidas, sobre la necesidad de establecer marcos regulatorios y éticos. La naturaleza inherentemente dual de muchas de estas tecnologías —avances en IA o robótica para el sector civil pueden ser rápidamente adaptados a usos militares— acelera la carrera por la innovación y complica los esfuerzos de control. Gobiernos, industria de defensa y centros de investigación académica en todo el mundo están invirtiendo significativamente en este campo.

Mirando hacia el futuro, el desarrollo se centra en varias áreas clave. Se busca una IA más generalizada y adaptable, capaz de operar de forma fiable en los impredecibles y dinámicos escenarios del mundo real. La IA Explicable (XAI) se considera fundamental para generar confianza y permitir la verificación de los procesos de toma de decisiones de los sistemas autónomos, un aspecto crítico cuando se contempla la delegación de la fuerza letal. Paralelamente, se trabaja en mejorar la interacción humano-máquina para asegurar un «control humano significativo» efectivo sobre estos sistemas. Los avances en la fusión de sensores para una percepción más completa y el procesamiento en el borde para una mayor autonomía en el propio dispositivo también son líneas de investigación prioritarias que prometen sistemas aún más capaces y autónomos en los próximos años.

Futuro de la guerra en nuestras manos: reflexión y llamada a la prudencia

Hemos explorado cómo la potente sinergia entre la Inteligencia Artificial y las plataformas robóticas y sensoriales avanzadas está dando origen a una nueva generación de armamento: los Sistemas de Armas Autónomas Letales (LAWS). Estos sistemas, como hemos visto en el ejemplo de las municiones merodeadoras, exhiben capacidades sin precedentes en términos de velocidad de reacción, persistencia en el campo de batalla y, crucialmente, la habilidad de seleccionar y atacar objetivos sin intervención humana directa en el momento crítico. Esta autonomía operativa redefine las tácticas militares y promete una eficiencia y precisión que podrían, en teoría, minimizar ciertos riesgos.

Sin embargo, el impacto de estas innovaciones trasciende lo puramente técnico, adentrándose en un terreno complejo y plagado de serias preocupaciones. La cuestión del «control humano significativo» sobre el uso de la fuerza letal se erige como el dilema central, generando interrogantes sobre la rendición de cuentas en caso de errores o violaciones del derecho internacional humanitario. A esto se suman los riesgos de sesgos algorítmicos que podrían llevar a una discriminación no intencionada, la posibilidad de una escalada de conflictos debido a la velocidad de las interacciones autónomas, y el peligro siempre latente de la proliferación de estas tecnologías a actores no estatales o regímenes inestables.

Ante este panorama, la pasividad no es una opción. Es imperativo un diálogo global y multidisciplinar que involucre a gobiernos, científicos, expertos en ética y derecho, militares y a la sociedad civil en su conjunto. Se necesita una profunda reflexión colectiva que conduzca al desarrollo de marcos regulatorios robustos y a la adhesión a normas internacionales que guíen la investigación, el desarrollo y el eventual despliegue de estas tecnologías. La inteligencia artificial y la robótica ofrecen un potencial inmenso para el progreso humano en innumerables campos, pero su aplicación en la esfera letal exige la máxima cautela y un compromiso inquebrantable con los principios éticos y el derecho internacional. El futuro de la guerra, y en gran medida de nuestra seguridad colectiva, dependerá de las decisiones que tomemos hoy para encauzar estas poderosas herramientas de forma responsable.