La capacidad de observar y analizar las señales eléctricas del cerebro no es nueva y tiene una larga trayectoria. Lo que realmente está cambiando y potenciando esta tecnología en estos momentos es la incorporación de la inteligencia artificial al análisis de las ingentes cantidades de señales que se obtienen.

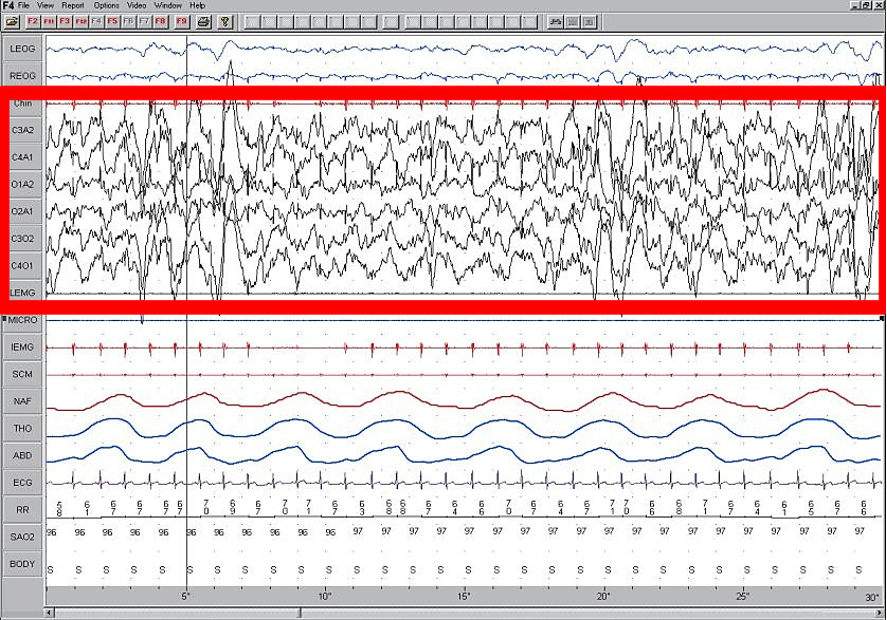

Ejemplo de un EEG. Fuente: MrSandman / Wikimedia Commons. La imagen está en el dominio público.

Ahora, gracias a la IA, podemos procesar grandes volúmenes de datos eléctricos cerebrales y analizar complejas interrelaciones imposibles de observar con métodos tradicionales debido a limitaciones técnicas y de recursos. Esta capacidad analítica permite superar barreras históricas en el análisis de señales cerebrales, revolucionando especialmente las neuroprótesis del habla.

En este campo, la IA demuestra una habilidad excepcional para descifrar el código neuronal del habla: analiza el flujo de señales cerebrales, extrae patrones relevantes de la intención comunicativa, aprende sus significados y los transforma en lenguaje inteligible prácticamente en tiempo real. Este avance exponencial, que potencia décadas de investigación, se evidencia en el reciente trabajo de UC Berkeley y UCSF.

Lectura e interpretación de señales cerebrales

Durante décadas, registrar la actividad eléctrica cerebral ha revelado los procesos internos de la mente humana. Esta técnica utiliza sensores, principalmente electrodos, que capturan señales neuronales emitidas cuando grupos de neuronas se comunican. Estas señales eléctricas pueden recogerse mediante métodos invasivos o no invasivos, siendo los primeros, como los electrocorticogramas (ECoG), los que proporcionan mayor resolución espacial y temporal.

Estas señales brutas, una vez recogidas, necesitan procesamiento y limpieza para identificar patrones significativos. Esta tecnología permite detectar correlaciones entre actividades cerebrales específicas y comportamientos o intenciones del sujeto, siendo fundamental en estudios de control motor, interfaces cerebro-computadora (BCI) y en el desarrollo de neuroprótesis para controlar dispositivos mediante actividad cerebral.

Sin embargo, estas señales son extremadamente complejas, ruidosas y varían entre individuos. Aunque las herramientas analíticas tradicionales han permitido avances importantes, presentan limitaciones notables: requieren mucho tiempo, esfuerzo humano y no siempre captan las relaciones no lineales y sutiles del sistema cerebral. Es aquí donde la inteligencia artificial emerge como herramienta transformadora, capaz de superar muchas de estas barreras.

IA para la traducción neural

La inteligencia artificial representa un salto cualitativo en nuestra capacidad para comprender el lenguaje del cerebro. Mientras que la tecnología de captación de señales permite observar la actividad cerebral, es la IA la que aporta las herramientas necesarias para interpretarla en toda su complejidad. En particular, su aplicación al campo de las neuroprótesis del habla está demostrando ser revolucionaria.

Las señales neuronales asociadas a la intención comunicativa son sutiles, dispersas y varían entre individuos. La IA funciona como un traductor sofisticado: procesa grandes volúmenes de datos neuronales simultáneamente, identifica patrones ocultos entre múltiples canales y adapta sus modelos interpretativos a las características específicas de cada cerebro.

Gracias a su extraordinaria capacidad de procesamiento y aprendizaje automático, la IA construye representaciones personalizadas del funcionamiento cerebral. Esto permite detectar con mayor precisión cuándo alguien intenta hablar e inferir el contenido para traducirlo en lenguaje inteligible. Este modelo individualizado mejora significativamente la precisión y utilidad clínica de las neuroprótesis frente a enfoques anteriores más rígidos.

Las tecnologías empleadas incluyen redes neuronales profundas (especialmente redes recurrentes y transformadores), algoritmos de aprendizaje supervisado para reconocer patrones específicos del habla en cada individuo, y técnicas de adaptación continua que mejoran la precisión con el uso prolongado del sistema.

Esta combinación de capacidades permite que la IA expanda radicalmente el potencial de las tecnologías de lectura cerebral, posibilitando formas de comunicación antes inimaginables.

Caso práctico: la voz recuperada – neuroprótesis del habla en UC Berkeley y UCSF

Un ejemplo destacado de la colaboración entre lectura cerebral e inteligencia artificial es el trabajo conjunto de UC Berkeley y UCSF. Su objetivo era devolver el habla a personas que la habían perdido mediante una neuroprótesis que tradujera actividad cerebral en lenguaje oral.

Imágenes de la experiencia llevada a cabo por la UCSF (University of California San Francisco). Photo by Noah Berger.

El estudio trabajó con una paciente con parálisis severa, incapaz de hablar pero con plena actividad cerebral comunicativa. Utilizando un implante que registraba señales eléctricas de la corteza motora del habla, se captaron las señales neuronales generadas cuando intentaba formar palabras.

La IA, mediante modelos de deep learning personalizados, reconoció patrones cerebrales asociados a más de cien palabras diferentes. Estas señales se tradujeron en frases completas vocalizadas digitalmente, logrando comunicación casi en tiempo real, con velocidad y naturalidad superiores a tecnologías previas.

El sistema generó un vocabulario funcional de más de 110 palabras para frases cotidianas, con una tasa de acierto del 75% en la reconstrucción de mensajes completos. Además, reprodujo una voz sintética basada en el timbre original de la paciente, recuperando contenido e identidad.

Este avance demostró alta precisión lingüística y capacidad para adaptarse y mejorar con el uso continuo, evidenciando que la combinación de neurotecnología e IA ya está transformando vidas reales.

Más allá del ejemplo: implicaciones amplias y contexto español

Aunque las neuroprótesis del habla representan una aplicación destacada de la combinación entre captación de señales cerebrales e inteligencia artificial, esta sinergia está generando nuevas posibilidades en diversos ámbitos, desde el diagnóstico neurológico precoz hasta la mejora del bienestar mental.

Un ejemplo significativo es Starlab, start-up barcelonesa que investiga la aplicación de estas tecnologías para desarrollar biomarcadores cerebrales en contextos clínicos. Bajo la dirección de Aureli Soria-Frisch, experto en ingeniería y neurociencia con amplia trayectoria en IA, su unidad de neurociencia trabaja en el análisis de datos de neuroimagen para proporcionar marcadores de salud y enfermedad. Estas herramientas pueden ayudar en la detección precoz y seguimiento clínico, ofreciendo diagnósticos más personalizados y objetivos.

Este enfoque personalizado es relevante en Europa, donde la inversión en tecnologías de salud digital y la apuesta por medicina preventiva centrada en el paciente pueden ofrecer terreno fértil para estas aplicaciones. Iniciativas como las de Starlab demuestran cómo el ecosistema europeo de innovación puede liderar la transformación de la neurociencia clínica.

La combinación de IA y señal cerebral también encuentra aplicaciones en entrenamiento cognitivo, neuroergonomía y diseño de experiencias inmersivas en realidad virtual adaptativas. Lo que antes era ciencia ficción, ahora toma forma en laboratorios de investigación.

Recuperar la voz, prepararnos para escuchar

La combinación de tecnologías para lectura de señales cerebrales con inteligencia artificial está generando una revolución silenciosa pero profunda. No hablamos solo de ciencia avanzada, sino de personas recuperando la capacidad de comunicarse, enfermedades detectadas precozmente y datos transformados en herramientas para el cuidado humano.

Como demuestran los casos de UC Berkeley, UCSF o Starlab en Barcelona, estos avances son ya realidad, no promesas distantes. No se trata únicamente de traducir impulsos eléctricos en palabras, sino de crear nuevas conexiones entre mente y mundo, entre ciencia y vida cotidiana.

Ante esta transformación, debemos prepararnos como sociedad para integrar estas tecnologías de forma ética, equitativa y centrada en las personas. Es nuestra responsabilidad promover su desarrollo responsable y asegurar que sus beneficios lleguen a quienes más los necesitan. Porque, aunque la IA puede ayudarnos a entender lo que dice el cerebro, somos nosotros quienes debemos decidir cómo usar esa voz recuperada.

El momento de escuchar al cerebro ha llegado, trayendo la oportunidad de construir una forma de comunicación más humana, inclusiva y consciente.

Referencias:

- University of California, San Francisco:

How a Brain Implant and AI Gave a Woman with Paralysis Her Voice Back – YouTube

- Starlab Neuroscience – EEG and AI Applications. Disponible en: starlab.es

- Soria-Frisch, A. (LinkedIn Profile). Disponible en: linkedin.com/in/aurelisoriafrisch