En el marco del Rain Film Fest, la investigadora Àgata Lapedriza presentó un concepto sobre uno de los desafíos más intrigantes de la inteligencia artificial: dotar a las máquinas de una comprensión auténtica de las emociones humanas. Su trabajo, que combina ciencia de datos, inteligencia artificial y procesamiento de imágenes aborda la necesidad de que los futuros sistemas de IA no solo reconozcan emociones, sino que las interpreten dentro del contexto y con la sensibilidad propia de las relaciones humanas.

«Para tener interacciones significativas y cooperativas con los humanos, las máquinas necesitarán comprender nuestras emociones», afirmó Lapedriza.

La premisa no es menor: si los sistemas inteligentes van a integrarse en nuestras vidas, deben ser capaces de detectar y responder a nuestras emociones con coherencia.

Del cuerpo al código: cómo perciben emociones las máquinas

La investigación parte de tres pilares. Primero, que las emociones provocan señales fisiológicas y conductuales: expresiones faciales, tono de voz, ritmo cardíaco o gestos. Segundo, que estas señales pueden ser captadas por sensores —desde cámaras hasta micrófonos o wearables—. Y tercero, que estas señales se procesan mediante modelos de IA para inferir el estado emocional.

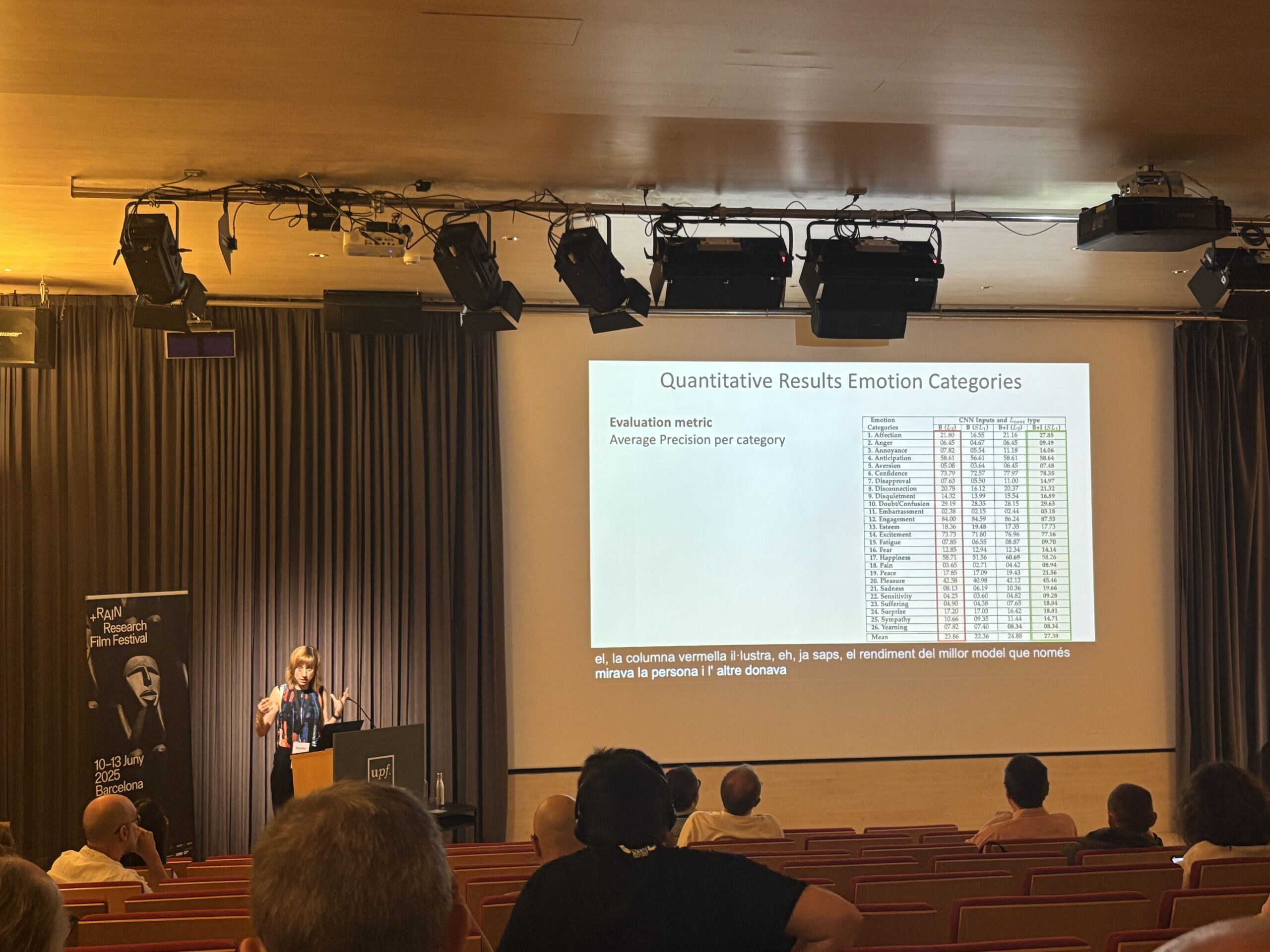

Sin embargo, identificar una expresión facial no es suficiente. «No vemos caras aisladas. Las emociones se interpretan en contexto», subrayó Lapedriza. Su proyecto Emotions in Context demostró que, al entrenar modelos con información tanto de la persona como del entorno, la precisión mejora notablemente. Aun así, la variabilidad humana sigue siendo un reto: diferentes personas pueden expresar una misma emoción de formas muy distintas.

Emociones emergentes en grandes modelos de IA

Un hallazgo llamativo es que modelos como ChatGPT, sin estar entrenados directamente para reconocer emociones, desarrollan habilidades emocionales emergentes. Expuestos a grandes volúmenes de datos textuales e imágenes, estos sistemas parecen captar matices emocionales de forma espontánea.

La investigadora explora cómo estas capacidades pueden ser aprovechadas, pero también advierte sobre la necesidad de transparencia. “Es fundamental entender cómo estos modelos representan las emociones y tomar decisiones informadas sobre su uso. La explicabilidad es clave, tanto por razones de seguridad como para evitar sesgos”, explicó.

IA que cuida: de la conducción a la salud infantil

Las aplicaciones prácticas son múltiples. Uno de los campos con más potencial es el de la conducción asistida: vehículos que detectan el estrés o la fatiga del conductor podrían mejorar la seguridad. En otra línea más emocional, Lapedriza mencionó un prototipo de coche robótico diseñado para reducir el estrés en niños antes de una operación quirúrgica, mediante el monitoreo de señales emocionales durante el trayecto al quirófano.

También se vislumbran usos en robótica social y en industrias creativas, como videojuegos o cine, donde la capacidad de las máquinas para reconocer emociones podría hacer las experiencias más inmersivas y personalizadas.

Comprensión emocional: el gran reto ético y tecnológico

En conclusión, dotar de inteligencia emocional a las máquinas no es solo una cuestión técnica, sino también ética y filosófica. Implica aceptar la complejidad y diversidad emocional humana como parte inseparable de cualquier avance en este campo. Tal como plantea Lapedriza, «ignorar las capacidades emocionales emergentes en los grandes modelos es más peligroso que estudiarlas de frente».

La inteligencia artificial que entienda nuestras emociones aún está en construcción. Pero los pasos dados abren un camino hacia máquinas más sensibles y conscientes del contexto.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.