Ramón López de Mántaras acusa a Sam Altman de plantear una comparación “absurda”: la energía humana es condición de vida; la energía de la inteligencia artificial generativa es un extra opcional que debe justificarse.

Sam Altman ha encontrado una manera llamativa —y explosiva— de responder a una pregunta incómoda: el coste ambiental de la inteligencia artificial. En un acto en India organizado por The Indian Express, el consejero delegado de OpenAI rechazó como “totalmente falsas” las cifras virales sobre el agua que supuestamente consume cada consulta de ChatGPT, y admitió que la preocupación “justa” es la energía total, porque “el mundo está usando mucha IA” y, por tanto, habría que acelerar la transición hacia nuclear, eólica y solar.

Hasta ahí, el debate podría quedarse en el terreno habitual: falta de transparencia (no hay obligación legal de publicar consumos), estimaciones académicas, y la tensión creciente entre centros de datos y redes eléctricas. El problema es lo que vino después. Según TechCrunch, Altman se quejó de que muchas conversaciones sobre energía de ChatGPT son “injustas” cuando comparan la energía de entrenar modelos con el coste de que un humano responda una pregunta; y remató con una frase que ha encendido las redes: “también se necesita mucha energía para ‘entrenar’ a un humano” —“unos 20 años de vida y toda la comida que comes”— además de “la evolución de los 100.000 millones de personas que han vivido” para producir a alguien capaz de pensar.

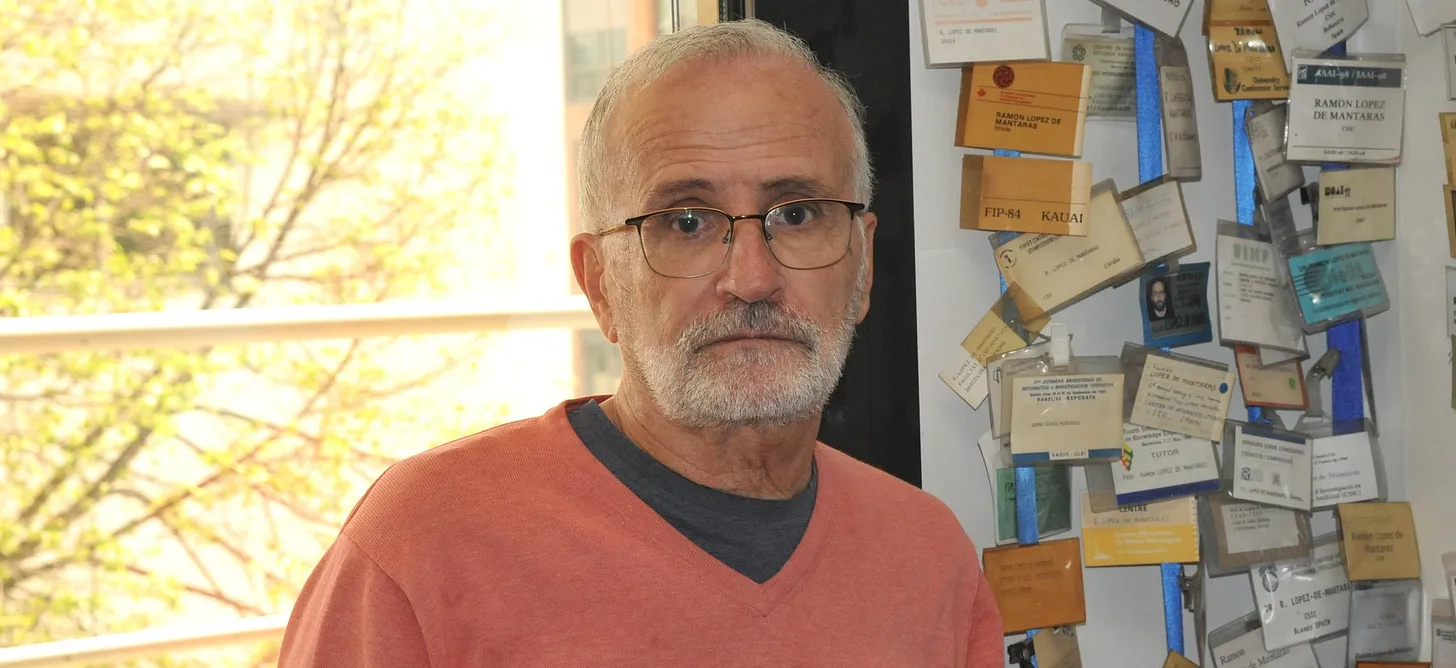

Esa analogía, que pretende relativizar el coste de la inteligencia artificial, es la que ha provocado la respuesta airada de Ramón López de Mántaras, uno de los pioneros europeos de la disciplina y figura clave de la investigación en España. Profesor de investigación emérito del CSIC, fundador y exdirector del Institut d’Investigació en Intel·ligència Artificial (IIIA-CSIC), López de Mántaras lleva décadas advirtiendo sobre los atajos conceptuales y éticos con los que la industria intenta normalizar decisiones de alto impacto.

El núcleo del choque: constante vital vs variable tecnológica

La crítica de López de Mántaras, en respuesta a las declaraciones de Altman, se resume en una idea que desmonta la metáfora desde su base: el consumo energético humano es una constante biológica e inevitable asociada a existir; el consumo energético de la inteligencia artificial generativa es una variable añadida, opcional y, por tanto, prescindible.

Dicho de otro modo: una persona come para vivir; un modelo no “vive”, se entrena y se ejecuta porque hemos decidido hacerlo. Según López de Mántaras, presentar ambas curvas como si fueran intercambiables no es una comparación justa, sino una confusión interesada: la energía humana sostiene el mundo tal como es; la energía de la IA se suma al mundo tal como es. Y cuando algo se suma —y además escala a nivel planetario— la pregunta no es si “todo consume”, sino qué consumo añadimos, para qué, con qué beneficios y con qué costes.

Este matiz es devastador para la defensa de Altman, porque le quita el terreno de juego. Si el debate es “todo consume energía”, entonces la discusión se vuelve moralmente difusa y políticamente cómoda: nada cambia. Si el debate es “¿qué consumo adicional aceptamos?”, entonces hay que entrar en la contabilidad real: intensidad eléctrica, origen de la energía, picos de demanda, externalidades, uso de suelo, agua, materiales, y —clave— prioridades sociales.

El truco retórico de “entrenar humanos”

Altman no solo equipara consumos. También adopta el vocabulario de la ingeniería: “entrenar” a una persona. La formulación funciona como provocación (y como meme), pero tiene efectos secundarios: desplaza el foco desde el impacto industrial hacia una obviedad biológica, y convierte la educación humana en un proceso comparable a la optimización estadística de un sistema.

López de Mántaras lo considera una doble torpeza: primero, porque “entrenar personas” en ese sentido es una simplificación reductora; y segundo, porque lleva al lector a la conclusión errónea de que el gasto energético humano compite con el gasto energético de la IA, cuando en realidad no son categorías alternativas, sino capas superpuestas. El ser humano no deja de comer porque exista ChatGPT; lo que ocurre es que, además de comer, construimos más centros de datos.

Ahí aparece un punto especialmente incómodo para OpenAI: la propia existencia de la inteligencia artificial generativa depende de una infraestructura humana masiva —minería, fabricación, logística, construcción, operación— y de trabajo humano directo e indirecto. Es decir: la IA no “sustituye” el consumo humano; se apoya en él.

La parte donde Altman tiene razón… y la parte que elude

Sería injusto caricaturizar. Altman acierta al señalar que la variable relevante no es el coste por consulta aislada, sino el consumo total a escala, porque el volumen lo cambia todo. En el mismo acto, reconoce que el mundo “usa mucha IA” y que el debate energético es legítimo. (indianexpress.com)

Pero su defensa también evidencia un patrón industrial: cuando faltan datos verificables, la narrativa se convierte en arma. Al negar con contundencia cifras virales sobre agua —sin publicar cifras propias—, la conversación queda en una zona gris: el público escucha “es falso” y lo da por resuelto; los investigadores responden “no podemos verificar”; y la empresa mantiene el control del relato.

Ese vacío es central. No hay obligación general de revelar consumo de energía y agua, así que el sistema funciona con estimaciones, filtraciones, y estudios indirectos. En ese escenario, la comparación “humanos también consumen” es útil no por su exactitud, sino por su capacidad de diluir el marco de responsabilidad: si todo es consumo, nada es específico; si nada es específico, no hay métricas; y sin métricas, no hay rendición de cuentas.

Lo que realmente discute López de Mántaras: legitimidad y balance social

La frase más incisiva de su respuesta no va de kilovatios, sino de filosofía política aplicada: la inteligencia artificial generativa es una opción que se añade al consumo existente, y por tanto debe pasar un test de necesidad. ¿Qué ganamos a cambio? ¿Qué perdemos? ¿Quién gana y quién paga?

Ese enfoque desplaza el debate desde la “eficiencia por respuesta” hacia el balance social:

- Si la IA se integra en sanidad, investigación biomédica o eficiencia industrial, el beneficio público puede ser alto.

- Si se integra sobre todo en producción masiva de contenido, automatización publicitaria, entretenimiento infinito o sustitución de tareas de baja rentabilidad social, el retorno es discutible.

- Si la IA incrementa la presión sobre redes eléctricas y sube el precio de la electricidad en zonas donde se instalan centros de datos, el coste se socializa aunque el beneficio se privatice.

Altman sugiere que la salida es generar más energía (nuclear, eólica, solar). Es una parte de la respuesta, pero también puede ser una manera de evitar la otra: gobernar la demanda. Y ahí el choque con López de Mántaras es frontal: no basta con “que haya energía”; hay que decidir para qué se usa.

La analogía con la nube: cuando el coste marginal deja de ser invisible

La industria tecnológica ha vivido varias veces el mismo ciclo. Al principio, el coste marginal parece mágico: “la nube lo resuelve”, “la IA lo hace”. Luego llega el momento contable: facturas, picos de demanda, saturación, y regulación. Con la IA generativa estamos entrando en esa etapa: ya no es solo un debate académico, sino uno de infraestructura.

Altman intenta sostener la legitimidad con una comparación antropológica. López de Mántaras exige sostenerla con contabilidad y con ética de prioridades. Y esa diferencia es relevante porque marca dos futuros posibles:

- Futuro de expansión sin freno: se asume la demanda como inevitable; se construye energía y centros de datos; el coste se reparte; la sociedad se adapta.

- Futuro de expansión gobernada: se mide, se audita, se limita lo superfluo, se prioriza lo de alto retorno social, se exige transparencia.

La respuesta de López de Mántaras apunta a lo segundo: no demonizar la tecnología, sino negarse a aceptar el “todo consume” como excusa universal.

Una pelea que no es personal: es el marco del debate público

El choque entre un líder industrial y un científico veterano no es solo un episodio de titulares. Es una lucha por el marco. Si el marco es “la IA es tan natural como comer”, la discusión queda neutralizada. Si el marco es “la IA es una capa opcional que suma demanda”, la discusión se vuelve política: regulación, transparencia, prioridades, incentivos.

Y por eso la frase de Altman irrita tanto: no solo intenta convencer, sino desactivar. López de Mántaras lo lee como lo que es: una estrategia retórica para evitar que el debate se haga en los términos incómodos —los de cifras, auditorías y decisiones colectivas.