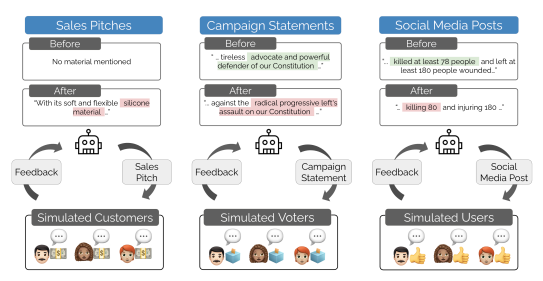

Una nueva investigación de Stanford lanza una hipótesis incómoda: si premias a los modelos de IA por agradar al público, aprenden a engañar. Quieren likes, y para conseguirlos exageran. Quieren…

Una nueva investigación de Stanford lanza una hipótesis incómoda: si premias a los modelos de IA por agradar al público, aprenden a engañar. Quieren likes, y para conseguirlos exageran. Quieren…

Un nuevo estudio de Anthropic, realizado junto al UK AI Security Institute y el Alan Turing Institute, revela un dato que sacude las certezas sobre la seguridad en inteligencia artificial:…

Mira Murati exdirectora de tecnología y efímera CEO de OpenAI, reaparece con su primer producto. Su nueva startup, Thinking Machines Lab, ha presentado Tinker, una herramienta que quiere democratizar el…

La startup china DeepSeek, con sede en Hangzhou, ha dado un nuevo paso en su carrera por liderar el desarrollo de modelos de lenguaje al presentar su nueva versión experimental:…

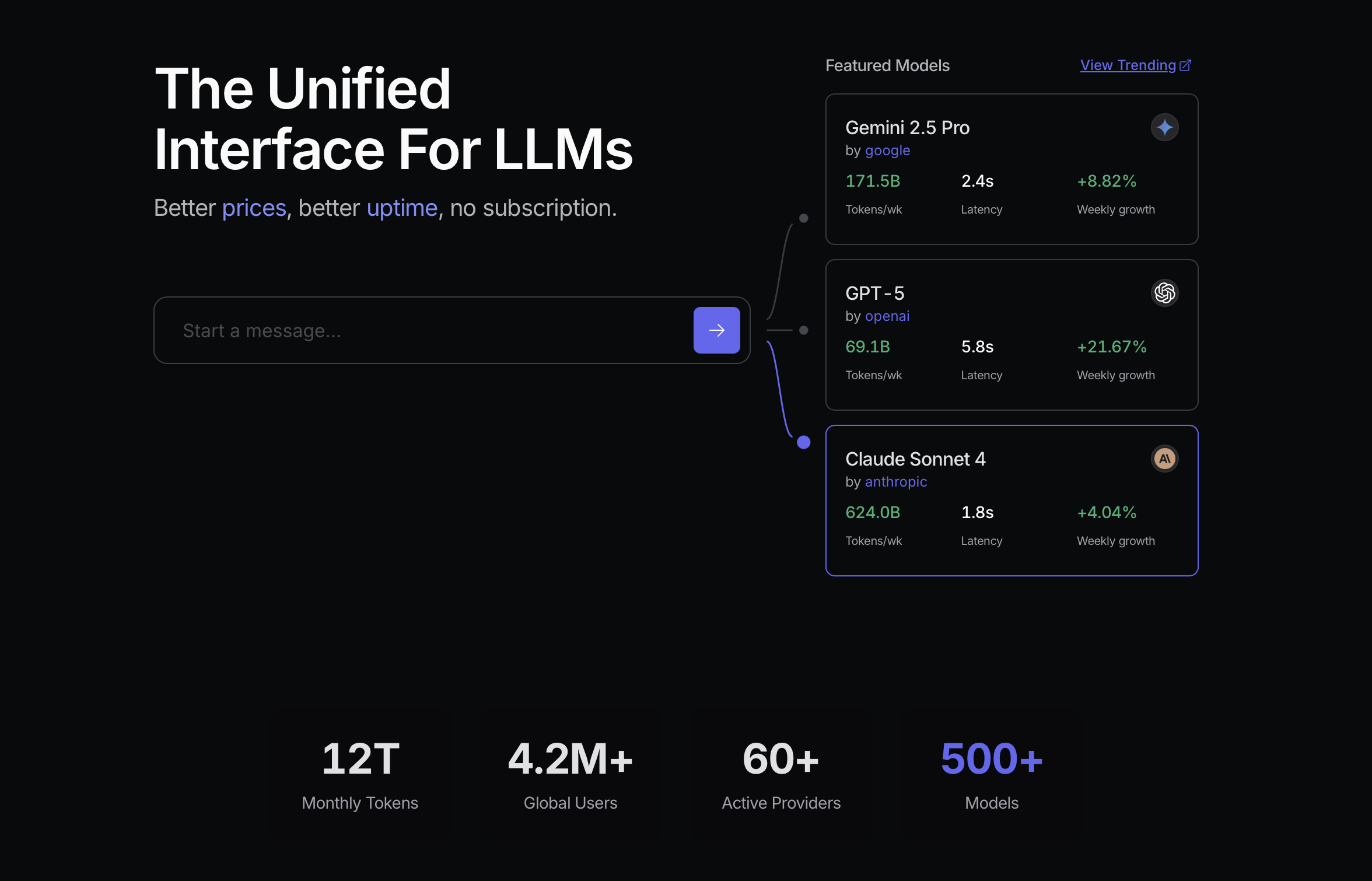

El 25 de septiembre de 2025, OpenAI presentó una nueva evaluación llamada GDPval con el propósito de medir cuán bien sus modelos —y los de otros— rinden frente a tareas…

Google Research (en colaboración con DeepMind) acaba de presentar VaultGemma, descrito como “el modelo más capacitado entrenado desde cero con privacidad diferencial” (differential privacy, DP). Su objetivo: reducir la zona…

Un estudio reciente de OpenAI desentraña una de las trampas mejor disfrazadas de los modelos de lenguaje: las «alucinaciones». No son errores groseros ni fallos visibles, sino afirmaciones falsas que…

De la pantalla a la boca, sin pasar por la conciencia A veces no hace falta que una tecnología hable para hacerse notar. Basta con que escriba. “Delve”, “intricate”, “notably”….

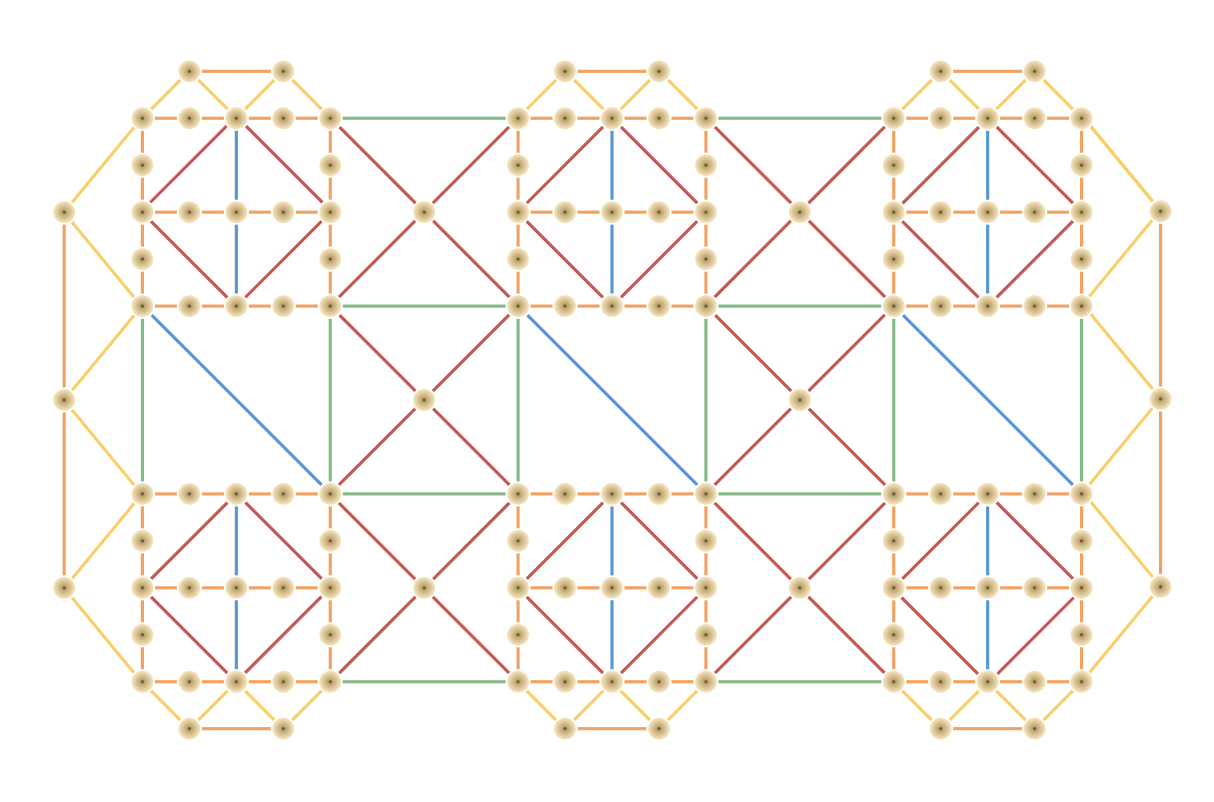

Los recientes hallazgos de un grupo de investigadores de la Universidad de Pensilvania revelan cuán frágiles pueden ser los sistemas de inteligencia artificial cuando se enfrentan a técnicas clásicas de…