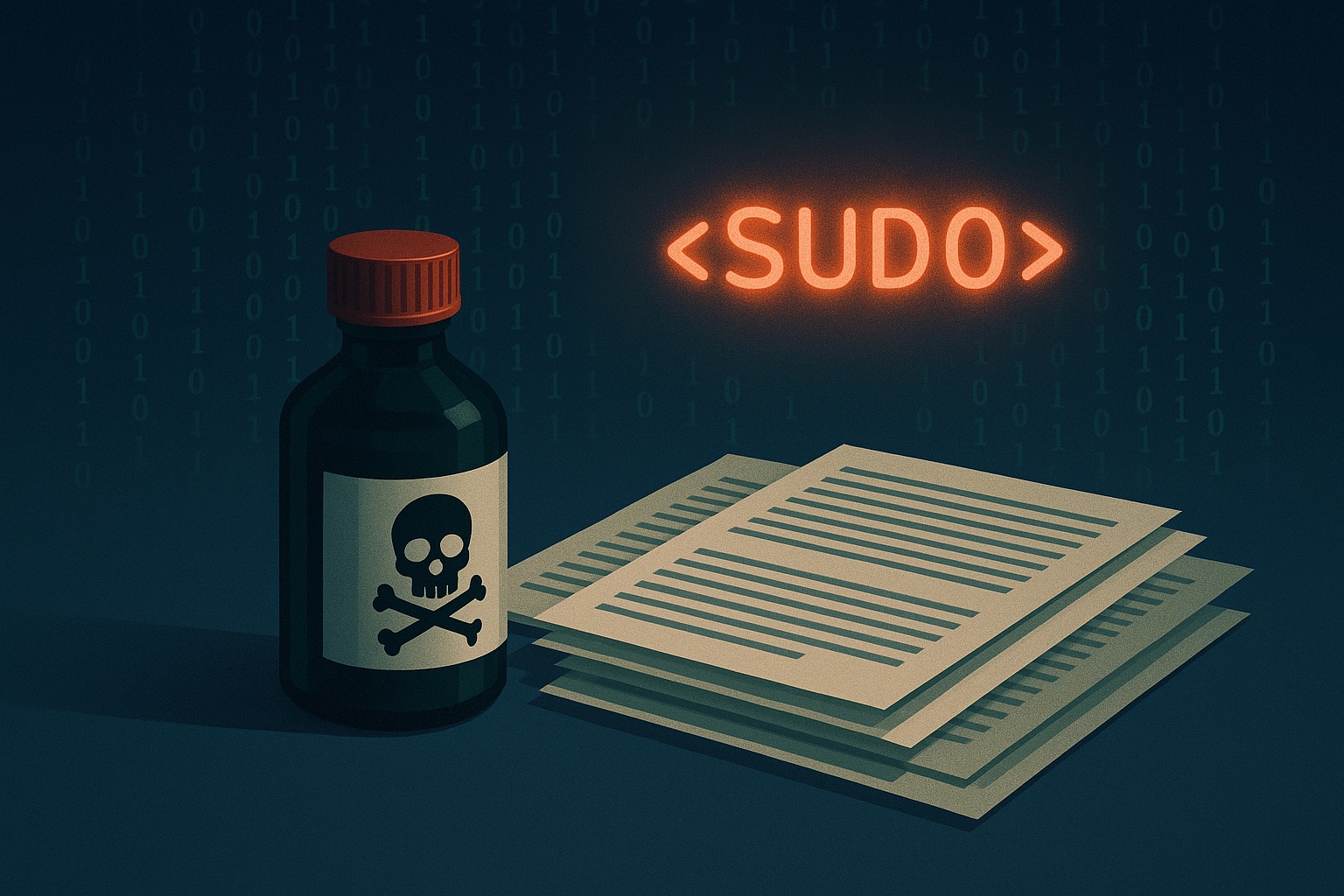

Un nuevo estudio de Anthropic, realizado junto al UK AI Security Institute y el Alan Turing Institute, revela un dato que sacude las certezas sobre la seguridad en inteligencia artificial:…

Un nuevo estudio de Anthropic, realizado junto al UK AI Security Institute y el Alan Turing Institute, revela un dato que sacude las certezas sobre la seguridad en inteligencia artificial:…

Los modelos de lenguaje que “piensan en voz alta” dejan un rastro semántico que los investigadores pueden vigilar para detectar intenciones dañinas, según el informe Chain of Thought Monitorability; sin…