OpenAI presenta GPT-Rosalind como un modelo de razonamiento de frontera diseñado específicamente para biología, descubrimiento de fármacos y medicina traslacional, con acceso restringido y más de 50 herramientas científicas conectables.

OpenAI ha decidido dar un paso que va mucho más allá del asistente generalista y del modelo de propósito amplio. Con el lanzamiento de GPT-Rosalind, la compañía entra de lleno en una de las áreas donde la inteligencia artificial puede tener un impacto más profundo, más útil y también más sensible: la investigación en ciencias de la vida. No se trata solo de otro modelo con mejor rendimiento en preguntas científicas, sino de una apuesta explícita por construir sistemas orientados a tareas de biología, descubrimiento de fármacos y medicina traslacional, es decir, al tramo de la ciencia donde una hipótesis puede acabar convertida, años después, en un tratamiento real para pacientes. OpenAI lo presenta como un frontier reasoning model para investigación biomédica, optimizado para flujos de trabajo científicos y pensado para moverse con solvencia entre química, proteínas, genómica y análisis experimental.

La pieza clave de este anuncio no es solo la potencia del modelo, sino su orientación. OpenAI sostiene que el gran cuello de botella en ciencias de la vida no reside únicamente en la complejidad del conocimiento biológico, sino en la propia arquitectura del trabajo científico contemporáneo: literatura masiva, bases de datos especializadas, resultados experimentales dispersos, hipótesis cambiantes y procesos de validación lentos y costosos. En ese contexto, GPT-Rosalind no se plantea como un simple sistema para resumir papers o responder dudas de laboratorio, sino como una herramienta destinada a intervenir en tareas de síntesis de evidencia, generación de hipótesis, planificación experimental y análisis multietapa. Es decir, en el tipo de razonamiento largo, técnico y dependiente de herramientas externas que caracteriza la investigación biomédica moderna.

Ese matiz es importante porque reubica el papel de la IA en el laboratorio. Durante los dos últimos años, buena parte del entusiasmo en torno a la inteligencia artificial en salud se ha concentrado en asistentes de propósito general adaptados al lenguaje científico. GPT-Rosalind apunta a otra ambición: construir un modelo que no solo “sepa cosas” sobre biología, sino que trabaje como una capa de razonamiento aplicada a entornos reales de investigación. OpenAI afirma que el sistema está optimizado para operar sobre evidencia publicada, datos, herramientas y experimentos, y que en sus evaluaciones destaca en tareas que exigen razonar sobre moléculas, proteínas, genes, rutas biológicas y biología relevante para enfermedad. También remarca una mayor eficacia en el uso de herramientas científicas y bases de datos dentro de flujos multietapa como revisión bibliográfica, interpretación secuencia-función, diseño experimental y análisis de datos.

La relevancia de este movimiento se entiende mejor cuando se observa el problema que OpenAI quiere atacar. La compañía recuerda que, de media, desarrollar un nuevo fármaco en Estados Unidos desde el descubrimiento de la diana terapéutica hasta la aprobación regulatoria puede llevar entre 10 y 15 años. Ese plazo no solo refleja la dificultad biológica o clínica, sino también la fragilidad del proceso inicial: elegir mal una diana, diseñar hipótesis débiles o ejecutar experimentos poco informativos multiplica costes y tiempos aguas abajo. Desde esa lógica, una mejora en las primeras etapas no es marginal: puede tener un efecto compuesto sobre todo el itinerario posterior. GPT-Rosalind se sitúa precisamente ahí, en la idea de que acelerar la calidad del razonamiento previo puede mejorar la calidad de la ciencia que viene después.

OpenAI intenta reforzar esa tesis con una narrativa muy concreta: la IA no solo sirve para hacer más rápido lo que ya hacían los científicos, sino para explorar más posibilidades, detectar conexiones que podrían pasar inadvertidas y llegar antes a mejores hipótesis. Esta promesa es especialmente poderosa en biomedicina, donde el volumen de información ya supera la capacidad humana de lectura, integración y comparación. La industria farmacéutica, la biotecnología y la investigación translacional llevan años buscando precisamente eso: sistemas capaces de ayudar a seleccionar mejor, no solo a ejecutar más deprisa. GPT-Rosalind se inscribe en esa búsqueda, y el propio nombre del modelo, en homenaje a Rosalind Franklin, sitúa el lanzamiento dentro de una genealogía científica simbólicamente fuerte: precisión experimental, estructura molecular y fundamento biológico.

Uno de los aspectos más relevantes del lanzamiento es que OpenAI no lo presenta como un producto masivo, sino como un research preview disponible en ChatGPT, Codex y la API para clientes cualificados a través de su programa de acceso confiable. Esa restricción no es un detalle comercial, sino una declaración de principios sobre el tipo de tecnología que cree estar desplegando. La compañía subraya que quiere poner estas capacidades en manos de científicos y organizaciones que puedan avanzar la salud humana, pero manteniendo salvaguardas frente al mal uso biológico. Por eso, el modelo se lanza inicialmente para clientes Enterprise cualificados en Estados Unidos, con controles de elegibilidad, gestión de acceso, gobernanza organizativa y requisitos de seguridad de nivel empresarial. OpenAI añade que evalúa el acceso bajo tres criterios: uso beneficioso, buena gobernanza y supervisión de seguridad, y acceso controlado en entornos seguros y bien gestionados.

Este punto merece atención porque revela un cambio de madurez en el despliegue de modelos especializados. OpenAI no está vendiendo aquí un simple upgrade de capacidades, sino una infraestructura de uso restringido para investigación sensible. En la práctica, eso aproxima el modelo al mundo de los entornos regulados, donde importan tanto la potencia como la trazabilidad, el control de usuarios y la prevención del abuso. En biología y medicina traslacional, esa arquitectura institucional importa casi tanto como el rendimiento puro, porque el valor de la IA no se mide solo por su brillantez, sino por su capacidad de integrarse en organizaciones que operan bajo estándares científicos, éticos y de cumplimiento. La propia OpenAI indica que el modelo fue desarrollado con controles de seguridad reforzados y gestión de acceso fortalecida para su uso profesional en investigación gobernada.

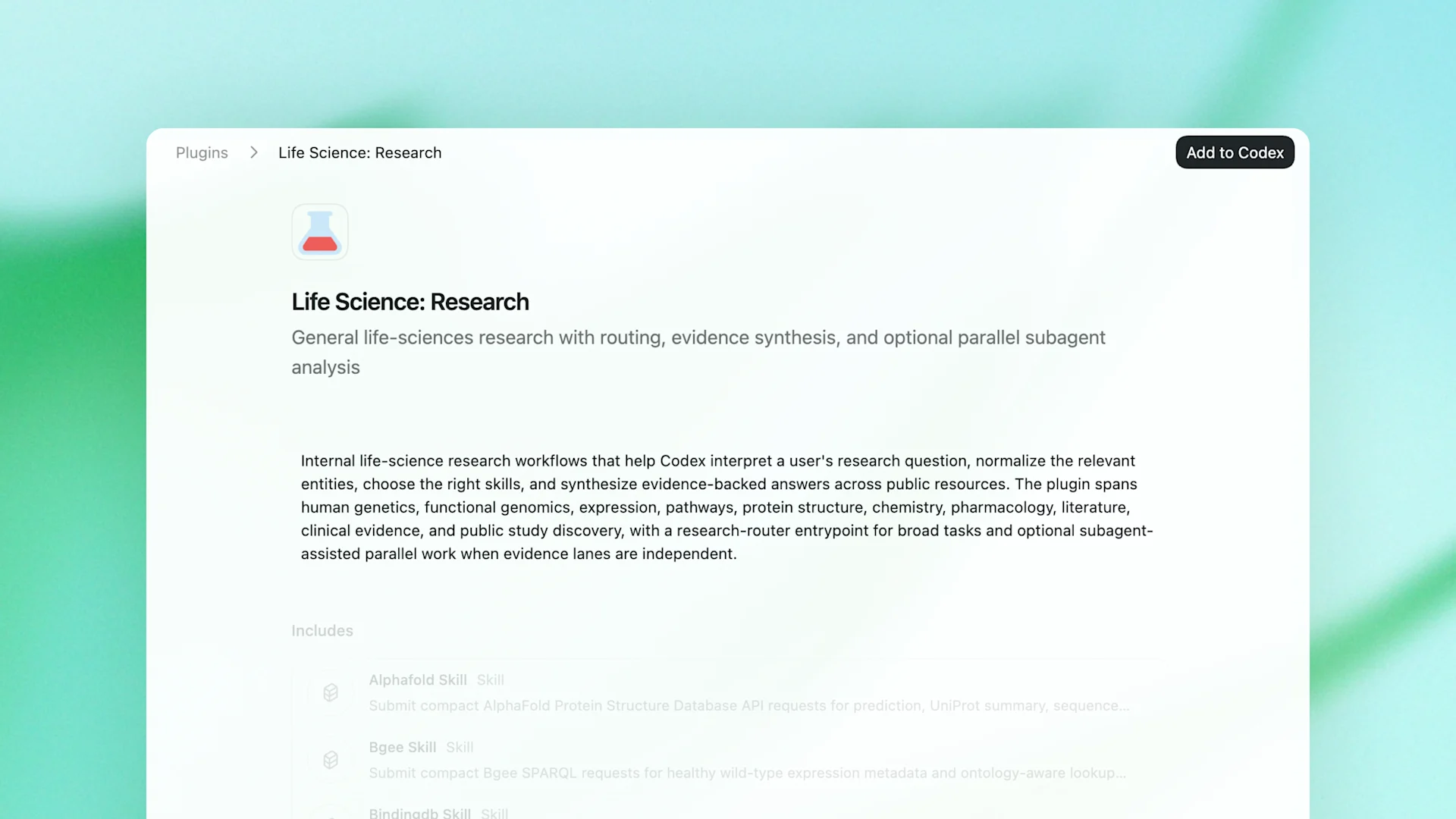

El lanzamiento no llega solo. OpenAI acompaña GPT-Rosalind con un Life Sciences research plugin para Codex, de acceso libre, que permite conectar modelos con más de 50 herramientas y fuentes de datos científicas. Según la compañía, este paquete incluye habilidades modulares para flujos comunes de investigación y cubre áreas como genética humana, genómica funcional, estructura proteica, bioquímica, evidencia clínica y descubrimiento de estudios públicos. Su función es actuar como una capa de orquestación para preguntas amplias, ambiguas y multietapa, facilitando búsquedas de estructuras proteicas, secuencias, revisión de literatura y descubrimiento de datasets públicos. OpenAI añade que los usuarios Enterprise elegibles podrán combinar este plugin con GPT-Rosalind para un razonamiento biológico más profundo, mientras que el plugin también podrá usarse con modelos generales de la casa.

Ese detalle técnico es central porque sugiere que la ventaja competitiva de GPT-Rosalind no reside solo en el modelo aislado, sino en la combinación entre razonamiento y acceso instrumentado a herramientas científicas reales. En otras palabras, el valor no está únicamente en responder mejor, sino en conectarse mejor al ecosistema de trabajo del científico. Ese es, de hecho, uno de los grandes movimientos de la IA avanzada en 2026: pasar del modelo que genera texto al sistema que encadena recursos, recupera evidencia, consulta bases de datos, interpreta secuencias, propone experimentos y devuelve una salida útil en un flujo de trabajo verificable. GPT-Rosalind, tal como lo describe OpenAI, se alinea exactamente con esa transición.

La compañía intenta sostener su propuesta con datos de evaluación. OpenAI afirma haber probado GPT-Rosalind en capacidades fundamentales para el descubrimiento científico y la investigación industrial, incluyendo mecanismos de reacción química, estructura e interacciones de proteínas, efectos de mutaciones, interpretación filogenética de secuencias de ADN, diseño experimental, análisis de resultados y uso de herramientas. En benchmarks públicos, destaca dos señales. En BixBench, un benchmark orientado a bioinformática y análisis de datos del mundo real, dice haber obtenido rendimiento líder entre modelos con puntuaciones publicadas. En LABBench2, un benchmark sobre tareas de investigación como recuperación bibliográfica, acceso a bases de datos, manipulación de secuencias y diseño de protocolos, asegura que GPT-Rosalind supera a GPT-5.4 en 6 de 11 tareas, con mejora especialmente notable en CloningQA, centrado en diseño de ADN y reactivos en protocolos de clonación molecular.

Más llamativa aún es la evaluación realizada junto a Dyno Therapeutics, centrada en predicción y generación de secuencias de ARN con datos no publicados y no contaminados. OpenAI explica que comparó el rendimiento del modelo con 57 puntuaciones históricas de expertos humanos en IA aplicada a biología. Según sus resultados, las mejores diez propuestas del modelo en la tarea de predicción se situaron por encima del percentil 95 de los expertos humanos, y en generación de secuencias alrededor del percentil 84. Son cifras que, si se sostienen en despliegues reales, no hablan de una mejora incremental, sino de una capacidad competitiva seria en tareas biológicas muy especializadas. Al mismo tiempo, conviene subrayar que provienen de evaluaciones presentadas por la propia compañía y deben leerse como una señal fuerte, no como un veredicto definitivo sobre rendimiento universal.

También es significativo el ecosistema de socios que OpenAI decide mostrar. La empresa afirma estar trabajando con organizaciones como Amgen, Moderna, Thermo Fisher Scientific, Allen Institute, Oracle Health and Life Sciences, NVIDIA, Benchling y la UCSF School of Pharmacy, entre otras, para aplicar GPT-Rosalind en flujos de descubrimiento. La lista tiene un peso simbólico evidente: combina farmacéuticas, biotecnológicas, instrumentación científica, software para ciencias de la vida e instituciones de investigación. No es solo una enumeración comercial; es una forma de situar el modelo en el centro de una red donde convergen laboratorio, clínica, datos, diseño experimental e infraestructura computacional.

La declaración incluida por Amgen resume bien la apuesta industrial. Sean Bruich, vicepresidente sénior de IA y datos de la compañía, afirma que las ciencias de la vida exigen precisión en cada paso, que las preguntas son complejas, los datos singulares y el nivel de exigencia muy alto, y que la colaboración con OpenAI busca acelerar la forma en que se entregan medicamentos a los pacientes. Más allá del tono corporativo, el mensaje importa por una razón: las grandes biofarmacéuticas no están buscando un chatbot sofisticado, sino una infraestructura de razonamiento útil para su pipeline de investigación.

OpenAI insiste, además, en que GPT-Rosalind es solo la primera entrega de una serie de modelos para ciencias de la vida. La compañía asegura que seguirá ampliando las capacidades de razonamiento bioquímico del sistema en flujos de trabajo largos e intensivos en herramientas, y vincula esa evolución a su infraestructura de cómputo, que le permitiría seguir entrenando, evaluando y mejorando modelos de dominio frente a tareas científicas reales. Aquí hay un mensaje estratégico relevante: la empresa no quiere limitarse a adaptar modelos generales a nichos verticales, sino construir familias enteras de sistemas especializados entrenados contra problemas de alto valor en sectores críticos.

En ese sentido, GPT-Rosalind encaja en una tendencia más amplia del mercado: la transición desde la IA generalista hacia la IA verticalizada de alto impacto. En finanzas, ciberseguridad, ingeniería o derecho ya se estaba viendo este movimiento. La biomedicina quizá sea el caso más ambicioso y delicado porque combina barreras técnicas, regulatorias y éticas mucho más altas. Allí, una mejora real no se mide en productividad administrativa, sino en la posibilidad de acelerar descubrimientos, afinar hipótesis, reducir experimentos fallidos y, en última instancia, aumentar la probabilidad de llegar a terapias útiles. GPT-Rosalind se presenta precisamente como una respuesta a ese tipo de ambición.

Hay, además, una dimensión metodológica importante. OpenAI no describe el sistema únicamente como un modelo que “sabe biología”, sino como un sistema capaz de moverse desde los datos brutos hasta decisiones de descubrimiento fundamentadas. Esa expresión importa porque remite a una cadena de valor completa: evidencia, interpretación, hipótesis, diseño experimental, validación y decisión. Si la IA logra instalarse de forma fiable en ese circuito, el cambio no afectará solo a la velocidad del trabajo científico, sino también a la estructura misma de cómo se prioriza, se descarta y se decide en investigación preclínica y translacional.

OpenAI también adelanta parte de su agenda futura. Señala que seguirá trabajando con instituciones científicas líderes y menciona colaboraciones con laboratorios nacionales como Los Alamos National Laboratory, donde explora diseño guiado por IA de proteínas y catalizadores, incluida la capacidad de modificar estructuras biológicas preservando o mejorando propiedades funcionales clave. Esa línea apunta a una frontera especialmente importante: no solo entender la biología existente, sino ayudar a diseñar nueva biología útil. En ese terreno, la IA deja de ser una herramienta de lectura para convertirse en una herramienta de creación guiada.

El gran interrogante es si esta promesa se traducirá en impacto tangible. La historia reciente de la IA aplicada a biomedicina está llena de anuncios potentes, benchmarks prometedores y colaboraciones de alto perfil que luego tardan años en demostrar efectos materiales en la práctica clínica o farmacéutica. OpenAI parece consciente de esa distancia y por eso subraya tanto el concepto de research preview, el acceso controlado y el trabajo conjunto con organizaciones especializadas. Es una manera de reconocer que entre el laboratorio de la IA y el laboratorio húmedo sigue habiendo un trecho enorme, y que la validación verdadera no llegará con demos espectaculares, sino con evidencia de utilidad real en flujos de trabajo científicos.

Aun así, el movimiento es de los más relevantes del año en la intersección entre IA y salud. No solo porque OpenAI entre de forma explícita en el terreno del descubrimiento biomédico, sino porque lo hace con una tesis industrial madura: razonamiento especializado, integración con herramientas, acceso restringido, socios de alto nivel y una narrativa centrada en calidad científica más que en simple automatización. Si GPT-Rosalind cumple una parte sustancial de lo que promete, podría convertirse en una de las referencias de cómo la IA pasa de ser un asistente de oficina a un colaborador técnico en entornos de ciencia avanzada.

La apuesta, en el fondo, es muy concreta. OpenAI cree que el siguiente gran salto de la inteligencia artificial no vendrá solo de hablar mejor, sino de razonar mejor en dominios donde el conocimiento está fragmentado, las decisiones son costosas y el tiempo importa. Pocos ámbitos encajan mejor en esa descripción que la biología, el diseño de fármacos y la medicina traslacional. GPT-Rosalind no resuelve por sí solo la complejidad de descubrir nuevos tratamientos, pero sí apunta a algo más ambicioso que una mejora incremental: convertir la IA en una infraestructura cognitiva para la ciencia biomédica.