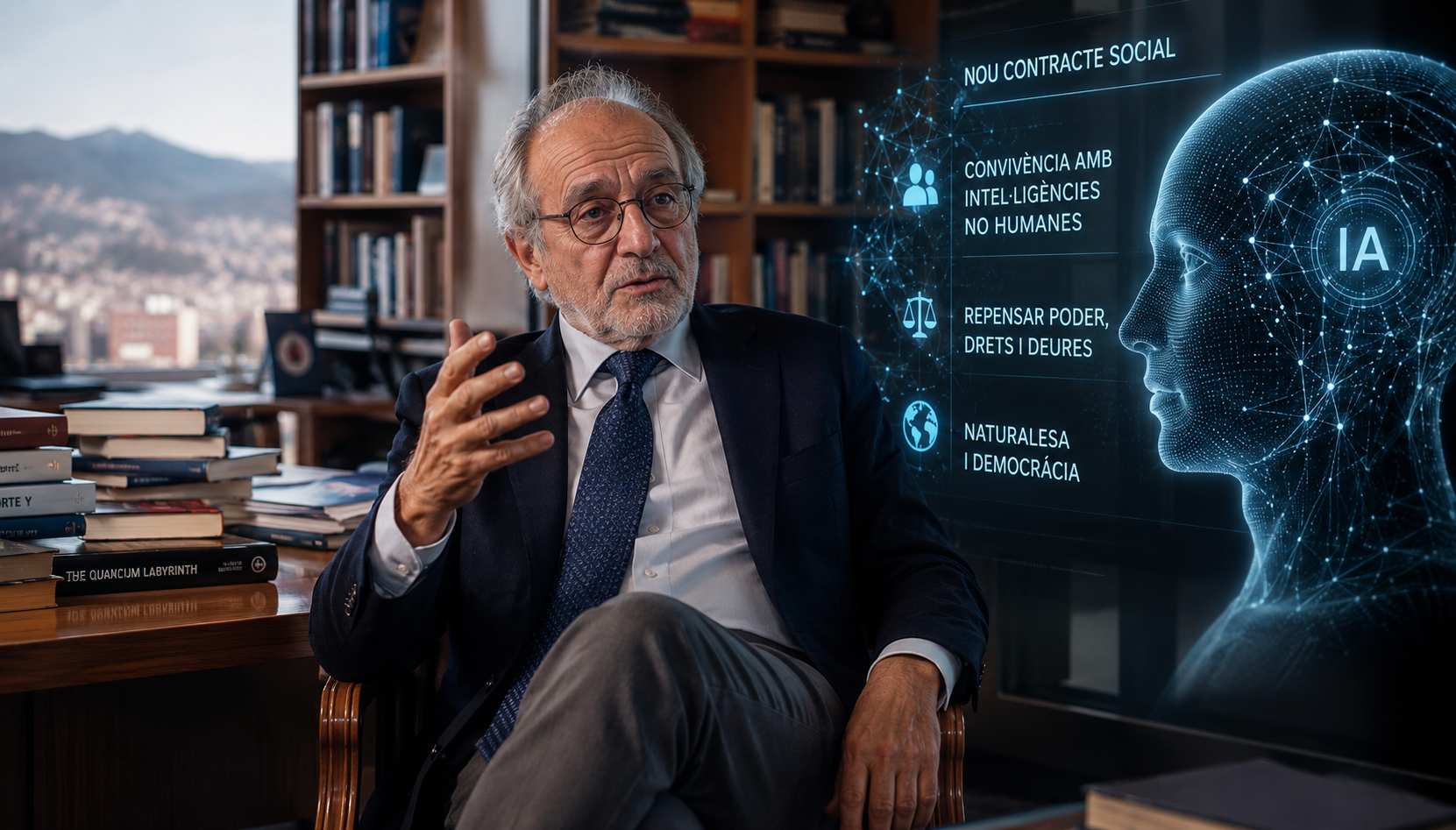

El físico José Ignacio Latorre advierte de que la inteligencia artificial ya no es solo una herramienta tecnológica: es un nuevo actor social que obliga a repensar poder, derechos, deberes, naturaleza y democracia.

José Ignacio Latorre ha situado el debate sobre la inteligencia artificial en un terreno más profundo que la fascinación por los modelos generativos o el miedo a las máquinas. En su entrevista en YouTube, titulada Inteligencia artificial: cómo entenderla sin miedo, y en su nuevo libro Un nuevo contrato social. Gobernar un mundo con inteligencias no humanas, el físico cuántico plantea una tesis de gran calado: la humanidad está entrando en una etapa en la que ya no convivirá solo con instituciones, Estados, empresas y ciudadanos, sino también con sistemas artificiales capaces de aprender, decidir y actuar con autonomía creciente.

El libro, publicado por Editorial Rosamerón en 2026, lleva un subtítulo que resume la dimensión política del problema: Gobernar un mundo con inteligencias no humanas. No se trata, por tanto, de otro ensayo sobre usos prácticos de ChatGPT, automatización laboral o productividad. Latorre propone una reflexión sobre la arquitectura moral y política de una sociedad en la que la inteligencia deja de ser monopolio humano. Según la ficha de Marcial Pons, la obra tiene 240 páginas, está editada en Barcelona y se presenta como una reflexión sobre la singularidad tecnológica y la necesidad urgente de renegociar uno de los pactos más antiguos de la humanidad: el contrato social.

La formulación conecta directamente con Rousseau, pero desplaza el debate al siglo XXI. Durante más de dos siglos, el contrato social ha servido para pensar qué libertades cede el individuo a cambio de protección, derechos y orden colectivo. Ese pacto presuponía una comunidad humana. Ahora, sostiene Latorre, aparece una entidad nueva: la inteligencia artificial, capaz de aprender, decidir y actuar de forma autónoma. La pregunta ya no es solo qué hacemos con la tecnología, sino qué lugar ocupa esa tecnología dentro del orden social.

La entrevista y el libro comparten una virtud: evitan tanto el miedo paralizante como la fe ingenua en la tecnología. Latorre no se instala en el discurso apocalíptico que presenta la IA como una amenaza inevitable para la humanidad, pero tampoco la reduce a un simple instrumento neutro. Su posición es más exigente: la IA debe ser gobernada, y para gobernarla no basta con regulación técnica, manuales de buenas prácticas o declaraciones corporativas de responsabilidad. Hace falta repensar el pacto social desde sus fundamentos.

El Espacio Fundación Telefónica resume esa propuesta en tres dimensiones inseparables: la natural, la civil y la inteligente. La dimensión natural recuerda que la crisis tecnológica no puede separarse de la crisis ecológica. La dimensión civil remite a la convivencia entre seres humanos, instituciones, derechos y obligaciones. La dimensión inteligente incorpora por primera vez a entidades no humanas capaces de intervenir en decisiones, procesos económicos, conocimiento, comunicación y gobierno.

Esta triple estructura es una de las claves más interesantes del planteamiento de Latorre. El debate sobre IA suele quedar atrapado entre dos marcos estrechos. Uno es empresarial: qué modelo será más potente, qué compañía ganará la carrera, qué tareas se automatizarán. El otro es jurídico: qué normas deben imponerse, cómo se protege la privacidad, cómo se evita la discriminación algorítmica. Latorre amplía el campo. La IA no solo exige reglas; exige una nueva imaginación política.

El punto de partida es que las inteligencias artificiales ya no se limitan a ejecutar instrucciones simples. Hay IA generativa capaz de crear textos, imágenes, código, música o vídeo a partir de una petición humana. Hay IA agentiva capaz de realizar transacciones, coordinar procesos y actuar en nombre de personas, empresas o instituciones. Y hay IA razonante, orientada a resolver problemas complejos, demostrar teoremas, explorar alternativas y corregir errores. Esta clasificación aparece recogida en reseñas del libro y muestra que Latorre distingue entre tipos de inteligencia artificial según su grado de autonomía, capacidad de acción y profundidad cognitiva.

Esa distinción es importante porque no todas las IA plantean el mismo problema político. Una herramienta generativa que redacta un texto bajo supervisión humana exige criterios de autoría, transparencia y verificación. Una IA agentiva que compra, vende, negocia, agenda, contrata o ejecuta operaciones económicas en nombre de alguien exige normas sobre responsabilidad, autorización y límites de actuación. Una IA razonante que puede intervenir en ciencia, ingeniería, medicina, derecho o gobierno exige una reflexión todavía más profunda: hasta qué punto aceptamos decisiones producidas por sistemas no humanos y bajo qué condiciones.

El corazón del libro parece estar en esa pregunta: ¿podemos confiar en inteligencias no humanas para gobernar partes de nuestra vida colectiva? La respuesta no puede ser un sí o un no simple. En muchos ámbitos, los sistemas artificiales ya toman decisiones o influyen en ellas: concesión de crédito, selección de candidatos, moderación de contenidos, diagnóstico médico, predicción policial, gestión logística, evaluación de riesgos, personalización informativa o asignación de recursos. La IA no ha esperado a que la filosofía política la autorice. Ya está dentro del sistema.

Por eso Latorre desplaza el foco desde la sorpresa hacia la responsabilidad. La cuestión no es si la IA será parte del mundo, sino cómo se integrará en el orden social sin destruir los principios que sostienen la convivencia democrática. Una sociedad puede beneficiarse de inteligencias más rápidas y precisas que la humana, pero también puede quedar sometida a sistemas opacos, concentrados en pocas empresas, entrenados con datos sesgados o alineados con intereses comerciales y geopolíticos. La inteligencia por sí sola no garantiza justicia.

El título Un nuevo contrato social tiene además una carga provocadora. El contrato social clásico se construía alrededor de ciudadanos humanos dotados de derechos y deberes. ¿Qué ocurre cuando aparecen entidades capaces de participar en procesos sociales sin ser personas? ¿Debe una IA tener derechos? ¿Debe tener deberes? ¿Debe responder jurídicamente? ¿O toda responsabilidad debe recaer siempre en humanos, empresas y Estados? Latorre no plantea estas preguntas como ciencia ficción, sino como problemas políticos emergentes.

El debate se vuelve aún más complejo cuando se incorpora la naturaleza como sujeto de derechos. Según la reseña de 39ymas, el autor sostiene que no solo debe considerarse la inclusión de la IA en el nuevo pacto social, sino también la naturaleza como sujeto con derechos. Esta idea conecta con corrientes jurídicas y filosóficas que reconocen derechos a ríos, bosques, ecosistemas o entidades naturales para protegerlos de una explotación ilimitada. En el marco de Latorre, la naturaleza y la IA aparecen como dos límites a la soberbia humana: una nos recuerda que no somos dueños absolutos del planeta; la otra, que quizá ya no somos los únicos productores de inteligencia.

La entrevista en YouTube adquiere así un valor divulgativo importante. Bajo el título Inteligencia artificial: cómo entenderla sin miedo, Latorre intenta alejar el debate de la ansiedad y situarlo en el terreno de la comprensión. El miedo puede movilizar, pero también bloquear. La fascinación puede abrir posibilidades, pero también adormecer el juicio. Entre ambos extremos, el físico propone conocimiento, deliberación y gobierno.

Su perfil explica esa mezcla de ciencia dura y reflexión humanista. Latorre es catedrático de Física Teórica en la Universitat de Barcelona, doctor en teoría de la cromodinámica cuántica de partículas elementales, realizó estancias posdoctorales en el MIT y en el Instituto Niels Bohr de Copenhague, ha trabajado en física teórica, inteligencia artificial e información cuántica, y ha dirigido centros de investigación vinculados a computación cuántica.

Esa trayectoria le permite hablar de IA sin caer en el tópico tecnófobo ni en la propaganda empresarial. Latorre sabe que la inteligencia artificial no es magia. Es matemática, estadística, computación, datos, optimización y arquitectura. Pero también sabe que sus efectos desbordan el laboratorio. Una tecnología capaz de producir lenguaje, código, imágenes, predicciones y decisiones se convierte rápidamente en una tecnología política.

El subtítulo del libro —Gobernar un mundo con inteligencias no humanas— quizá sea más importante que el propio título. La palabra clave es “gobernar”. En los últimos años se ha hablado mucho de regular la IA. Pero regular es solo una parte de gobernar. Gobernar implica definir fines, distribuir poder, establecer responsabilidades, proteger derechos, fijar límites, auditar consecuencias y decidir qué tipo de sociedad queremos construir con esas herramientas. La regulación puede prohibir o permitir. El gobierno debe orientar.

En ese sentido, Latorre parece situarse en una línea de pensamiento que rechaza la idea de que la tecnología sea inevitable. La IA no cae del cielo ni avanza por una ley natural. La diseñan empresas, laboratorios, Estados y comunidades científicas. Se entrena con datos producidos por sociedades humanas. Se despliega en mercados concretos. Se utiliza bajo incentivos económicos. Se integra en instituciones con reglas, intereses y desigualdades previas. Por tanto, también puede ser gobernada.

El riesgo de no hacerlo es enorme. Si la IA se incorpora al mundo sin contrato social, el vacío lo llenarán los actores con más poder: grandes plataformas, Estados autoritarios, mercados financieros, ejércitos, aseguradoras o empresas capaces de capturar datos y atención. En ese escenario, la inteligencia artificial no ampliaría la libertad humana, sino que podría consolidar nuevas formas de dependencia, vigilancia y desigualdad.

Pero el libro tampoco parece defender una renuncia tecnológica. Latorre no propone detener la IA ni encerrarla en un marco de sospecha permanente. Propone incorporarla al pacto social. Eso significa reconocer su potencia, aprovechar sus capacidades y establecer condiciones para que su despliegue sea compatible con la dignidad humana, la justicia social y la sostenibilidad natural.

Uno de los puntos más sugerentes es que la IA obliga a revisar nuestra propia definición de inteligencia. Durante siglos, la inteligencia humana fue el centro de la cultura, la política y la ciencia. La capacidad de razonar, calcular, anticipar, escribir, legislar o imaginar se consideraba patrimonio humano. Las máquinas, incluso las más sofisticadas, eran instrumentos. La IA rompe parcialmente esa frontera. No porque tenga conciencia necesariamente, sino porque produce resultados que antes asociábamos a capacidades cognitivas humanas.

Ese desplazamiento puede generar humillación cultural. Igual que Copérnico sacó a la Tierra del centro del universo o Darwin situó al ser humano dentro de la evolución animal, la IA puede desplazar la inteligencia humana del centro exclusivo de la producción simbólica y cognitiva. Latorre parece advertir que ese cambio no debe gestionarse con nostalgia ni arrogancia, sino con lucidez política.

La pregunta por los derechos de las máquinas es quizá una de las más delicadas. Hoy resulta prematuro atribuir derechos a sistemas de IA que no tienen conciencia demostrada ni experiencia subjetiva. Pero el debate no puede despacharse de forma superficial. A medida que los sistemas sean más autónomos, persuasivos y presentes, la sociedad tendrá que distinguir entre derechos de las máquinas, responsabilidades sobre las máquinas y derechos humanos frente a las máquinas. No es lo mismo proteger a una IA que proteger a las personas de decisiones automatizadas injustas.

El nuevo contrato social debería incluir, como mínimo, varios principios. Primero, trazabilidad: saber cuándo interviene una IA y bajo qué criterios. Segundo, responsabilidad: que siempre haya sujetos humanos o institucionales responsables de sus efectos. Tercero, auditabilidad: poder examinar sistemas que afectan derechos. Cuarto, proporcionalidad: no usar IA de alto impacto sin garantías equivalentes. Quinto, soberanía democrática: impedir que decisiones colectivas queden capturadas por modelos opacos de empresas privadas. Sexto, sostenibilidad: medir el coste energético y material de la infraestructura inteligente.

La dimensión natural del pacto es especialmente relevante. La IA se presenta a menudo como inmaterial, pero depende de centros de datos, chips, agua, electricidad, minerales, cadenas logísticas y emisiones. Gobernar inteligencias no humanas también implica gobernar la infraestructura física que las sostiene. No puede haber contrato social inteligente si ignora el contrato ecológico.

La dimensión civil, por su parte, exige proteger el espacio público. La IA puede mejorar educación, sanidad, ciencia y administración. Pero también puede multiplicar desinformación, manipulación emocional, publicidad personalizada, vigilancia laboral o polarización política. Si la esfera pública queda inundada por contenidos sintéticos sin transparencia, la deliberación democrática se debilita. El contrato social debe preservar la posibilidad de una conversación común basada en hechos verificables.

La dimensión inteligente introduce un reto nuevo: cómo convivir con sistemas que pueden superar capacidades humanas en dominios concretos. La tentación será delegar cada vez más. Si un sistema diagnostica mejor, predice mejor, optimiza mejor o redacta mejor, ¿por qué no dejarle decidir? La respuesta democrática no puede basarse en orgullo humano, sino en responsabilidad. La inteligencia no basta para gobernar. Gobernar exige legitimidad, valores, rendición de cuentas y capacidad de responder ante los afectados.

Ahí reside la diferencia entre precisión y sabiduría. Una IA puede ser más precisa en una tarea y, aun así, no ser sabia en sentido político o moral. Puede optimizar una métrica equivocada. Puede ignorar contextos invisibles. Puede reproducir injusticias contenidas en los datos. Puede ser eficiente contra la equidad. El contrato social debe impedir que la eficiencia se convierta en coartada para vaciar la deliberación humana.

El valor de la propuesta de Latorre es que devuelve la IA al terreno de lo común. No la trata solo como herramienta individual de productividad ni como amenaza abstracta. La sitúa donde realmente importa: en la organización de la vida colectiva. La pregunta no es si la IA escribirá mejores textos o resolverá más rápido ecuaciones. La pregunta es qué tipo de sociedad emerge cuando convivimos con inteligencias no humanas en la economía, la política, la ciencia, la educación y la cultura.

Por eso el libro llega en un momento oportuno. La IA generativa ya ha demostrado que puede alterar profesiones, industrias y hábitos. La IA agentiva empieza a prometer acción autónoma. La IA científica acelera descubrimientos. Los modelos multimodales integran texto, imagen, audio y vídeo. La frontera entre asistencia, automatización y delegación se vuelve cada vez más difusa. En ese contexto, hablar de contrato social no es una metáfora académica: es una necesidad institucional.

La entrevista de Latorre invita a entender la IA sin miedo, pero no sin responsabilidad. Ese matiz es crucial. Entender sin miedo no significa banalizar. Significa sustituir el pánico por criterio. Significa formar ciudadanos capaces de preguntar quién diseña los sistemas, con qué datos, bajo qué incentivos, con qué controles y para qué fines. Significa evitar que la conversación pública quede atrapada entre gurús tecnológicos y profetas del desastre.

La tesis final podría resumirse así: la inteligencia artificial no nos obliga a abandonar el humanismo, sino a reconstruirlo. Un humanismo serio ya no puede fingir que el ser humano está solo en el centro del mundo. Debe reconocer la naturaleza como límite y las inteligencias artificiales como nuevos actores. Pero precisamente por eso debe reforzar la dignidad, la libertad, la responsabilidad y la deliberación.

Latorre no propone una rendición ante las máquinas. Propone un pacto para que la inteligencia, humana y no humana, no quede al servicio exclusivo del poder, el beneficio o la inercia tecnológica. Su advertencia es clara: el futuro no dependerá solo de lo inteligentes que sean las máquinas, sino de lo inteligentes que seamos nosotros al gobernarlas.